Dezinformacja: Jak działa, jakie są trendy, kto za tym stoi?

Ali Bongo Ondimba chciał dobrze, ale wyszło jak zawsze. Pozycja prezydenta Gabonu od jakiegoś czasu była bardzo chwiejna. Przez kilka miesięcy nie pokazywał się publicznie, a cały kraj obiegały plotki o jego fatalnym stanie zdrowia. Miał podobno wyjechać na leczenie do Arabii Saudyjskiej, porzucając kraj. Albo, według innych pogłosek, od dawna nie żył, a krajem rządził spisek jego popleczników.

Aby uspokoić sytuację, prezydent postanowił wygłosić noworoczne orędzie. 1 stycznia 2019 r. pojawił się więc na ekranach, żeby raz na zawsze udowodnić, że panuje nad sytuacją. I niemal ostatecznie stracił nad nią kontrolę.

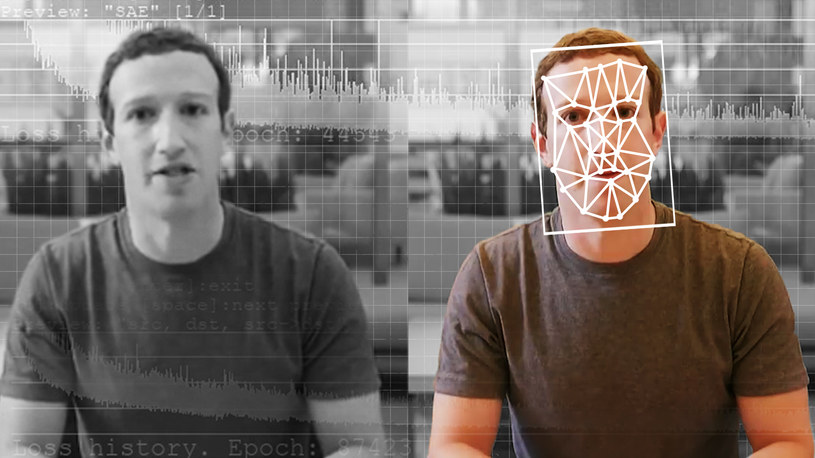

Po kraju błyskawicznie rozeszła się plotka, że osobą, która przemówiła w nowy rok, wcale nie był prezydent, a aktor bądź jeden z ministrów, którego wizerunek został cyfrowo przetworzony tak, by przypominać prezydenta. Przemówienie miało być deepfakiem - to słowo jak burza podbiło internet od kiedy w 2017 r. anonimowy programista udostępnił w sieci narzędzia pozwalające cyfrowo podmieniać twarze na nagraniach każdemu z minimalną informatyczną wiedzą. Siła plotki narastała lawinowo, aż w tydzień po emisji orędzia wojsko Gabonu podjęło próbę przeprowadzenia zamachu stanu, powołując się na "nietypowe zachowanie" prezydenta na nagraniu jako dowód tego, że władzę w kraju pełni ktoś inny.

Zamach stanu się nie powiódł, ale pokazywał doskonale jaką siłę mogą mieć deepfaki - nie trzeba nawet ich wykorzystywać, by osiągnąć skutek. Wystarczy sama hipotetyczna możliwość ich wykorzystania, by podkopać wiarę ludzi w to, co widzą na własne oczy.

Pierwsze prace nad podobnymi technologiami trwały jeszcze na początku lat 90., ale początkowo ograniczały się do ośrodków akademickich i największych studiów grafiki komputerowej. Dziś i narzędzia, i moc obliczeniowa, dostępne są dla każdego. Od 2017 r. specjaliści od dezinformacji przestrzegają, że sfałszowane nagrania mogą stać się prawdziwą bombą atomową trafiając w niepowołane ręce.

Te kasandryczne wizje na razie się nie spełniają. Przypadki wykorzystania deepfake’ów w polityce są niezwykle rzadkie i zazwyczaj ograniczają się do reklamówek politycznych, w których fakt, że nagranie zostało zmanipulowane, jest dosyć jasny.

Co nie oznacza, że deepfaki nie są wykorzystywane przez "złych graczy". Tyle, że ich zastosowania na razie ograniczają się najczęściej do zwykłych przestępstw.

W 2020 r. przestępcy wykorzystali sfałszowane filmy do kradzieży 76 mln dolarów w Chinach. W tym samym roku sfałszowany głos dyrektora firmy w Zjednoczonych Emiratach Arabskich posłużył do wyłudzenia 35 mln euro. W ubiegłym roku oszuści w Indiach, posługując się sfałszowanymi nagraniami, nakłaniali użytkowników tamtejszych aplikacji randkowych do dzielenia się nagimi zdjęciami - po czym wykorzystywali je do szantażu.

Plagą są też podrobione filmy porno, w których twarz aktorki jest zastępowana przez inną. Coraz częściej są wykorzystywane w tzw. "revenge porn", w celu zniszczenia czyjejś reputacji

Co nie oznacza, że ryzyko wykorzystania deepfake’ów w celu szerzenia dezinformacji na masową skalę zniknęło. Po prostu szum, jaki otaczał tę technologię na samym początku sprawił, że odbiorcy i media byli na nie o wiele bardziej wyczuleni.

Na razie najważniejsze narzędzia w arsenale siewców dezinformacji są o wiele prostsze. Co nie oznacza, że mniej skuteczne.

Siewcami dezinformacji kierują dwa motywy. Kasa i władza.

Kasa, bo dezinformacja po prostu doskonale się sprzedaje. Kłamstwa mają jedną przewagę nad prawdą: prawda może być nudna, kłamstwa mogą zaś być zaprojektowane tak, by błyskawicznie przyciągać uwagę. Dezinformacja to najlepszy na świecie clickbait.

Co szybciej przyciągnie uwagę: nagłówek o kolejnym badaniu potwierdzającym skuteczność szczepionek, czy złowieszcza zapowiedź tego, że ONI chcą odebrać ci WOLNOŚĆ albo poddać EKSPERYMENTOWI MEDYCZNEMU? Na dobrze napisany clickbait nabierają się nawet ludzie, którzy powinni zdecydowanie lepiej się orientować.

A kliknięcia przekładają się na wpływy z reklam. Strony z fake newsami, zazwyczaj budowane tak, by przypominały prawdziwe portale informacyjne, bywają dla ich twórców doskonałym źródłem dochodu. Global Disinformation Index, agencja oceniająca wiarygodność 70 000 witryn z wiadomościami, szacowała w 2020 r., że europejskie witryny z fałszywymi wiadomościami zarabiają około 75 mln USD na reklamach rocznie.

Strony przestrzegające przed "chciwością Big Pharma" same wyciągają z tego interesu grube miliony.

Taka dezinformacja często zaczyna się od działalności chałupniczej. Doskonałym przykładem jest niewielkie miasto Veles w Północnej Macedonii: za czasów Jugosławii było ośrodkiem produkcji porcelany. Dziś mieszkańcy tłuką fake newsy. Podczas amerykańskich wyborów prezydenckich, badacze namierzyli ponad 100 stron z fake newsami tworzonych przez obrotnych Macedończyków. Grały na obie strony, choć większość wspierała Donalda Trumpa. Mieszkańcom Veles było zazwyczaj wszystko jedno, kto wygra, ale protrumpowskie fake newsy po prostu lepiej się klikały i przynosiły większą kasę.

Jest jednak druga strona problemu: władza.

Bo chałupnicza dezinformacja dawno musiała ustąpić miejsca masowej produkcji fejków na potrzeby polityków, partii czy całych państw.

Raport Uniwersytetu Oksfordzkiego za rok 2020 stwierdzał, że zmasowane kampanie cyfrowej, internetowej propagandy i dezinformacji były prowadzone przez 81 krajów - o 11 więcej, niż w poprzednim roku. Część z nich tworzy własne "siły propagandowe" - Rosja czy Chiny stworzyły liczne, dobrze wyszkolone "cyberarmie" których zadaniem jest sianie propagandy i tępienie przeciwników.

Ale w coraz większym stopniu państwa po prostu kupują takie usługi. Oxford szacuje, że na świecie istniało w 2020 r. co najmniej 65 firm świadczących kompleksowe usługi w zakresie propagandy, oczerniania i dezinformacji. Zgarniają nawet 60 milionów dolarów za rozsiewanie kłamstw.

Oczywiście ich najskuteczniejszą bronią są media społecznościowe. "Farmy trolli" mają tak naprawdę dwa zadania: oszukiwanie algorytmów i wykorzystywanie efektów z zakresu psychologii społecznej do oszukiwania ludzi.

Algorytmy dają się nabrać na dezinformację, bo oparte są na prostym założeniu: im więcej ludzi przesyła dalej lub reaguje na jakiś post, tym najwyraźniej jest ciekawszy i przekazują go dalej same w nadziei na to, że kolejni użytkownicy też się nim zainteresują. I spędzą więcej czasu na Facebooku czy Twitterze.

Wszystkie duże platformy mediów społecznościowych mają z tym problem, ale czasem ich własne działania go pogłębiają, zamiast pomagać: z ujawnionych przez sygnalistkę Frances Haugen dokumentów wynika, że algorytm Facebooka od 2017 r. zdecydowanie częściej promował te posty, które prowokowały "rozgniewane" reakcje niż te, które wywoływały reakcje neutralne. A manipulacja gniewem to podstawowe narzędzie siewców dezinformacji.

Ludzie dają się manipulować równie łatwo. Psychologia społeczna mówi, że w kwestiach, w których nie mamy mocno wyrobionego zdania, mamy tendencję do podążania za głosem większości. To w sumie zdrowa taktyka ewolucyjna - jeśli nie wiem, które owoce są jadalne, a które trujące, najlepiej sprawdzić, co jedzą miejscowi. Ale w mediach społecznościowych jest przerażająco łatwa do zmanipulowania: wystarczy, żeby pod kontrowersyjnym tematem pojawiał się tłum komentatorów wykrzykujących argumenty jednej strony, by zasiać wątpliwości.

Tu pojawia się jednak problem siewców propagandy. Skala ich działań stale rośnie, ale rosną także koszty, bo i teksty na stronach z fake newsami i komentarze muszą pisać ludzie. A ludzie są drodzy i pracują wolno.

Wiele wskazuje jednak na to, że w dezinformacji nadchodzi prawdziwa technologiczna rewolucja. Która może doprowadzić do tego, że zostaniemy zalani falą nowych kłamstw.

W ubiegłym roku grupa badaczy z Centrum Bezpieczeństwa i Wschodzących Technologii Uniwersytetu Georgetown wykorzystała opracowany przez organizację Open AI algorytm do generowania tekstów GPT-3 do stworzenia dezinformacji.

GPT-3 to program, który, wyuczony na miliardach stron prawdziwych artykułów, książek, postów internetowych czy wierszy jest w stanie tworzyć naturalnie brzmiące teksty na zadany temat, często wręcz imitując styl konkretnych autorów. Jego twórcy udostępnili go jedynie innym naukowcom właśnie dlatego, że obawiali się wykorzystania swojego narzędzia do tworzenia internetowej propagandy.

Naukowcy z Georgetown postanowili sprawdzić, czy komputer potrafi wygenerować teksty, które są w stanie efektywnie manipulować opiniami ludzi. Nadzorowany przez nich algorytm przez pół roku generował fałszywe artykuły prasowe, posty czy tweety, które następnie były testowane na ochotnikach.

"Przy odrobinie ludzkiej kuracji, GPT-3 jest całkiem skuteczny" przestrzega w Wired prof. Ben Buchanan.

Naukowcy pokazali ochotnikom próbki tekstów napisanych przez GPT-3 o wycofaniu wojsk amerykańskich z Afganistanu i sankcjach USA wobec Chin. W obu przypadkach okazało się, że badani chętnie łykali podawane im treści. Na przykład po obejrzeniu postów sprzeciwiających się sankcjom wobec Chin, odsetek respondentów, którzy wyrazili sprzeciw wobec takiej polityki, podwoił się. Szczególnie perswazyjne okazały się krótkie posty i tweety. Długie komputerowo tworzone teksty wciąż nie mają takiej samej siły, jak pisane przez uzdolnionego, ludzkiego propagandzistę.

Naukowcy uprzedzają: podobne algorytmy mogą wkrótce zalewać nas zlecanymi przez swoich mocodawców fejkowymi wiadomościami. Szczególnie chętnie wykorzystywane przez siewców nieprawdy są ostatnio nie Facebook czy Twitter, ale komunikatory, takie jak WhatsApp, które pozwalają docierać do milionów użytkowników niemal bez nadzoru.

Może się okazać, że następnym, który będzie chciał cię oszukać w ogóle nie będzie człowiek.