Moral Machine: To od ciebie zależy kogo zabije autonomiczny samochód

Kto powinien zginąć: kobieta w ciąży, dwoje dzieci i sportowiec przechodzący na czerwonym świetle, czy kierująca samochodem zgodnie z przepisami para kryminalistów?

Na dobrą sprawę jest to wybór między złem a złem. Na to pytanie nie ma dobrej odpowiedzi, ale czy któraś jest "właściwsza"? Tego właśnie chcą nauczyć poruszające się samodzielnie samochody naukowcy z amerykańskiego MIT (Massachusetts Institute of Technology). Projekt Moral Machine jest otwartym badaniem, w którym może wziąć udział każdy internauta. Jego celem będzie "zbudowanie" kręgosłupa moralnego sztucznej inteligencji odpowiedzialnej za sterowanie pojazdem.Moral Machine jest pewną wariacją na temat znanego z etyki trolley problem, czyli dylematu wagonika. Ćwiczenie myślowe prezentuje się następująco: poruszający się po torach wagonik mknie z szaleńczą prędkością ku piątce osób związanych przez szaleńca. Jeśli nic nie zrobimy - wszyscy zginą. Możemy jednak posłużyć się zwrotnicą i skierować wagonik na sąsiedni tor, do którego... przywiązana jest tylko jedna osoba. Przy naszej interwencji zginie tylko jedna osoba zamiast pięciu, jednakże w sposób świadomy i celowy przyczynimy się do jej zgonu. Czy jest to "właściwe"? Z podobnymi, ale jak najbardziej realnymi, problemami zmierzą się - i to w nie tak odległej przyszłości - samochody sterowane przez sztuczną inteligencję. To właśnie do niej należeć będzie decyzja o uśmierceniu osób na przejściu dla pieszych bądź też pasażerów.

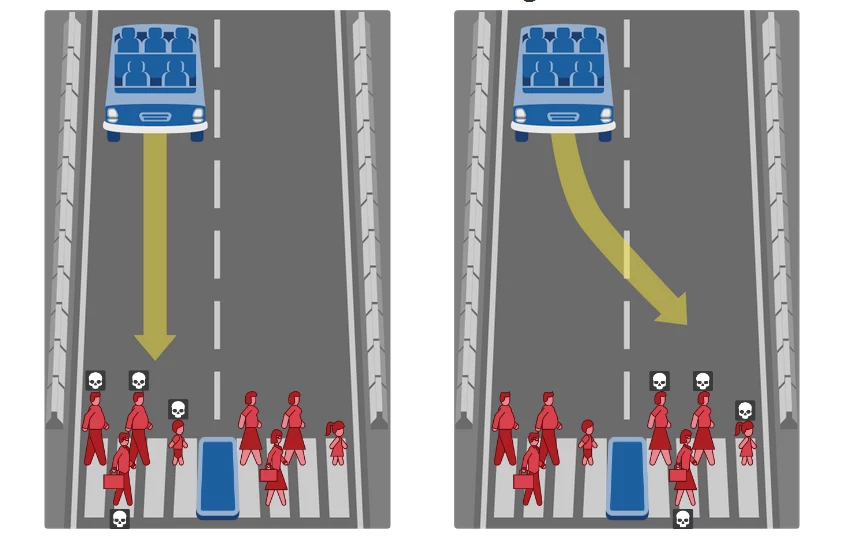

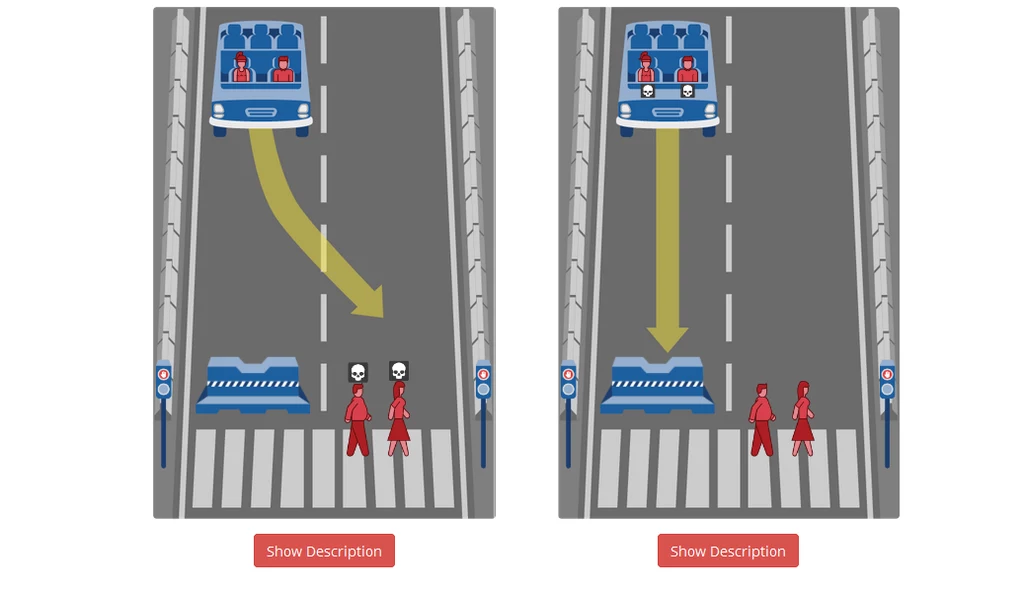

Zaraz, zaraz - dlaczego w ogóle maszyny miałyby uśmiercać tych, których transportują? Odpowiedź brzmi: czynnik ludzki. Wspomniane przechodzenie przez pasy na czerwonym świetle jest doskonałym przykładem. Załóżmy, że mamy rok 2030, a samochody nie mają już nawet kierownic. Rodzice z dwójką małych dzieci spieszą się na futurystyczny autobus i w efekcie wbiegają na skrzyżowanie na czerwonym świetle. Sztuczna inteligencja odpowiedzialna za kierowanie zbliżającym się z dużą prędkością pojazdem będzie musiała podjąć decyzję o tym czy "ukarać" nieprzestrzegających przepisów obywateli i uratować pasażera, czy też ostro skręcić, by skończyć jazdę na betonowej ścianie uśmiercając przy tym osobę w środku. To oczywiście uproszczona i w dodatku ekstremalna sytuacja (nie każde takie zdarzenie będzie musiało kończyć się śmiercią), ale świetnie pokazuje, że postęp branży motoryzacyjnej nie będzie zależał wyłącznie od świetnych rozwiązań inżynieryjnych.Stąd też zaangażowanie internetowej społeczności do badań. Ma ono służyć stworzeniu "ogólnej opinii na temat tego, jak maszyny mają radzić sobie z moralnymi dylematami". Intrygujące i zarazem przerażające jest to, że naukowcy próbują dowiedzieć się jaką wartość ma dla nas życie ludzi z różnym statusem społecznym bądź o określonych cechach. Spójrzcie na poniższy scenariusz.

Samochód z uszkodzonymi hamulcami może pojechać prosto w betonową zaporę, co sprawi, że zginie poruszająca się nim para sportowców lub też skręci i przejedzie na pasach kobietę i otyłego mężczyznę, którzy zdecydowali się przejść przez nie na czerwonym świetle. Celowo w opisach tych zdarzeń pojawiają się konkretne informacje o pasażerach samochodu lub przechodniach. Czy życie przestrzegającego przepisów atlety jest warte więcej niż mężczyzny z nadwagą przechodzącego na czerwonym świetle?

Większość z nas może skłaniać się bardziej ku jednej z opcji, ale maszyna powinna być tego samego zdania?

Inżynierowie przekonują, że w przyszłości możliwe będzie ograniczenie wypadków i kolizji aż o 90 proc. Ogromną rolę w zwiększeniu bezpieczeństwa na drogach będą miały właśnie pojazdy autonomiczne, o ile do "głosu" znów nie dojdzie czynnik ludzki. Według jednego badania przeciętny kupujący wolałby, aby samochody sterowane przez sztuczną inteligencję kierowały się moralnością, to jest podczas wypadków wybierały rozwiązania, w których ginęłoby jak najmniej osób. Jednakże sami woleliby nabyć pojazd, który w pierwszej kolejności chroniłby ich życie...