Nie tylko widzi, ale też czuje. Inżynierowie zbudowali robota ze zmysłem dotyku

Dotyk jest zmysłem, który w przeciwieństwie do wzroku i słuchu dość trudno odwzorować w świecie cyfrowym i maszynowym. To samo z robotami. Do nawigacji i chwytania obiektów z reguły wystarcza im wzrok - często rozszerzony o dodatkowe czujniki - bądź też świadomość ułożenia własnego ciała w przestrzeni. Inżynierowie zbudowali tymczasem robota ze zmysłem dotyku. System nosi nazwę TactileAloha i pomaga robotom chwytać oraz przenosić obiekty, podobnie jak robią to ludzie.

Spis treści:

- Nieczuła maszyna? Roboty mogą teraz czuć dotyk

- System TactileAloha. Zmysł dotyku pomoże robotom naśladować ludzi

- Robot AI jako asystent, czyli kto ci poda szklankę wody na starość

Nieczuła maszyna? Roboty mogą teraz czuć dotyk

Dzięki kamerom i mikrofonom urządzenia nie mają problemu z pobieraniem obrazu i dźwięku jako danych wejściowych. Z dotykiem jest już trudniej. Co prawda istnieją ekrany dotykowe, ale są one płaskie i niespecjalnie rozróżniają zniuansowane bodźce dotykowe. Podobnie jest w drugą stronę. Urządzenia tłumaczą sygnał cyfrowy lub analogowy na obraz na monitorze, goglach VR czy wyświetlany rzutnikiem, oraz dźwięk w głośnikach lub słuchawkach.

Z dotykiem eksperymentowano poprzez specjalne rękawice haptyczne, które miały odwzorowywać opór stawiany przez wirtualne obiekty w środowisku VR, tak aby człowiek mógł je realistycznie odczuwać. Istnieje kilka takich rozwiązań, jednak trudno mówić o ich powszechnym zastosowaniu. Jeszcze trudniej jest ze zmysłem węchu.

Podobnie jest z robotami AI. Do poruszania się i chwytania obiektów używają zmysłu wzroku lub wewnętrznych czujników odwzorowujących zmysł kinestetyczny (propriocepcję), czyli świadomość położenia własnego ciała i kończyn w przestrzeni. Wzrok może tu być szerzej rozumiany niż u ludzi, bowiem do orientacji przestrzennej (czujnik głębi) wykorzystywać może zakres podczerwieni lub światło lasera (jak w systemie Lidar).

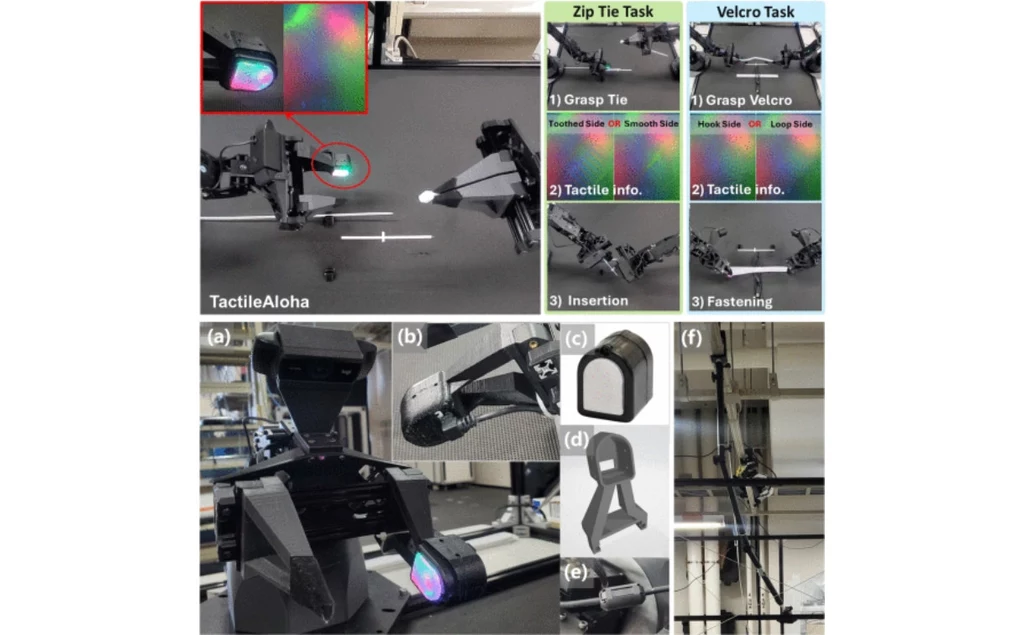

Naukowcy opracowali tymczasem nowy zmysł dla robotów AI. Ich system TactileAloha łączy rozpoznawanie bodźców wizualnych i dotykowych, co o wiele bardziej "uczłowiecza" robota i pozwala mu obchodzić się z obiektami z prawdziwego świata bardziej, jak istoty biologiczne.

System TactileAloha. Zmysł dotyku pomoże robotom naśladować ludzi

Dlaczego akurat zmysł dotyku u robota ma naśladować ludzi? Prawdopodobnie dlatego, że nasze dłonie - podobnie jak innych ssaków naczelnych - cechuje wyjątkowa precyzja w manipulowaniu obiektami. Dzięki temu robot AI, w tym także robot humanoidalny, który nie jest na stałe przytwierdzony do jednego miejsca i działa swobodnie w szeroko pojętym świecie rzeczywistym, jest w stanie wykonywać czynności, przy których sam wzrok by nie wystarczył. To np. obsługa zapięć na rzepy albo zamków błyskawicznych. Do tego potrzeba większych zdolności manualnych, co bez czułego dotyku stanowi ogromne wyzwanie.

"Tekstura dotykowa jest kluczowa dla robotycznej manipulacji, ale stanowi wyzwanie dla obserwacji kamery opartej na wzroku. Aby na nie odpowiedzieć, prezentujemy TactileAloha, zintegrowany system robotyczny taktylno-wizyjny zbudowany na bazie Aloha, z sensorem dotykowym zamontowanym na chwytaku, służącym do rejestrowania informacji o drobnoziarnistej teksturze i wspierania wizualizacji w czasie rzeczywistym podczas teleoperacji, ułatwiając efektywne gromadzenie danych oraz manipulowanie [obiektami]" - wyjaśniają inżynierowie z Tohoku University (Japonia) oraz University of Hong Kong (Chiny).

Wspomniana wyżej Aloha (A Low-cost Open-source Hardware System for Bimanual Teleoperation) to system zaprojektowany na Stanford University, który umożliwia prowadzenie zdalnych działań z wykorzystaniem robotów dwuramiennych. Zarówno jego warstwa sprzętowa, jak i oprogramowanie rozwijane są na licencji Open Source, co pozwala na ich bezpłatne wykorzystanie w innych projektach.

Za pomocą czego robot dotyka? Inżynierowie zainstalowali trójwymiarowy sensor dotykowy GelSight na systemie Aloha. Jedynie tą częścią "ciała" robot jest w stanie czuć. To jeszcze nie jest sztuczna skóra, która dawałaby mu czucie praktycznie całą swoją powierzchnią.

Robot AI jako asystent, czyli kto ci poda szklankę wody na starość

TactileAloha stanowi przykład podejścia multimodalnego w robotyce, co oznacza przetwarzanie danych wielu rodzajów - takich jak obraz, dźwięk i dotyk. Termin ten ostatnio zyskał na popularności za sprawą multimodalnej sztucznej inteligencji, której modele takie jak GPT-5 potrafią przetwarzać dane tekstowe, dźwiękowe, wizualne, wideo i nie tylko.

Wielozmysłowy robot AI sprawdzi się nie tylko w przemyśle czy np. w policji, ale też w codziennych czynnościach. System TactileAloha będzie mógł zostać zintegrowany z robotami pracującymi np. jako asystenci osób starszych lub niepełnosprawnych. Taki robot nie tylko zobaczy, jak daleko jest przysłowiowa szklanka wody na starość, ale również precyzyjnie ją wyczuje swoją dłonią lub chwytakiem, a następnie poda ją człowiekowi.

Źródło: N. Gu, K. Kosuge, M. Hayashibe, TactileAloha: Learning Bimanual Manipulation With Tactile Sensing, IEEE Robotics and Automation Letters, vol. 10, no. 8, pp. 8348-8355, Aug. 2025, doi: 10.1109/LRA.2025.3585396.