Kiedy będziemy rozmawiać z maszynami?

Rozwój nowych technologii nie pozostawia złudzeń. Pewnego dnia obok ludzi światem będą rządzić inteligentne maszyny. Jak wiele czasu dzieli nas od tej chwili?

Nad istotą sztucznej inteligencji debatuje się regularnie na wielu płaszczyznach. Nie ulega wątpliwości, że utrzymując obecne tempo rozwoju technologicznego w końcu stworzymy "jakąś" postać sztucznej formy życia. Ale kiedy tak naprawdę będzie możliwa komunikacja z komputerami, na takim poziomie jak robiła to załoga USS Enterprise w serii "Star Trek" lub Dave Bowman w "2001: Odysei kosmicznej" Arthura C. Clarke'a? Być może szybciej niż nam się wydaje...

Obecnie najczęściej występującą formą nawigacji urządzeń elektronicznych jest dotyk. Klawiatury, ekrany dotykowe czy sterowanie za pomocą bezprzewodowych kontrolerów służy nam do obsługi pecetów, tabletów oraz konsoli do gier wideo. Trudno się temu dziwić, skoro to właśnie dotyk jest najbardziej pierwotną formą komunikacji człowieka. Już wkrótce może się to zmienić, zwłaszcza że najwięksi producenci coraz częściej obok dotyku stawiają na głos. Najlepszym na to potwierdzeniem jest Siri znana z iPhone'a 4S, choć podobnych poliglotów jest znacznie więcej. To najlepszy dowód na to, że jesteśmy bliżej rozmów z maszynami niż kiedykolwiek wcześniej.

Ivee, budzik który słucha

Wiele osób na pewno słyszało o technologii Ford Sync lub kontroli głosowej telewizorów Samsunga. Oparte są one na "bezmyślnym" sterowaniu głosem i, mimo że samochód lub telewizor mogą w ten sposób wykonać dla nas proste zadania, daleko im do bardziej zaawansowanych form komunikacji. Całość działa na zasadzie akcji i reakcji: my prosimy o lokalizację najbliższej chińskiej restauracji lub sprawdzenie repertuaru kin, a po chwili otrzymujemy oczekiwane wyniki albo na ekranie, albo w postaci słownej.

Sync rozpoznaje ponad 1000 poleceń, technologia Samsunga trochę mniej. Główną wadą obu systemów jest konieczność korzystania ze specyficznej składni, nieużywanej zazwyczaj przez normalnych ludzi. Na podobnej zasadzie działa ivee FLEX IV2 - sterowane głosem radio z budzikiem, które można kupić już za 70 dol. Wystarczy powiedzieć "Hello, ivee!", a gadżet aktywuje się gotowy do realizacji 43 głosowych komend, wśród których znalazły się takie banały jak wskazanie aktualnej godziny, ustawienie budzika, zmiana dźwięku alarmu czy uruchomienie radia. Niestety, ivee nie zawsze odpowiednio reaguje na nasz głos - czasami może uruchomić się w wyniku przypadkowej rozmowy czy choćby odgłosów z telewizora.

Ford Sync, Samsung TV oraz ivee FLEX IV2 to systemy oparte na podstawowej kontroli głosowej. Mając z nimi do czynienia trzeba uzbroić się w cierpliwość i nauczyć odpowiedniego języka. Mr. Spock z serialu "Star Trek" raczej z żadnym z nich by się nie dogadał.

Siri, twoja inteligentna asystentka

Siri to inteligentna asystentka dostępna w smartfonie iPhone 4S (pojawiła się także wersja na iPhone'a 4), wykorzystująca funkcję rozpoznawania mowy, a także jej przetwarzania na tekst i odwrotnie. Siri nie cierpi na charakterystyczną dla technologii Forda, Samsunga i ivee semantyczną głupotę. Jej umiejętność rozumienia mowy potocznej jest unikatowa w skali świata elektroniki użytkowej, stąd też przez wielu uznawana jest jako ogromne osiągnięcie w kierunku stworzenia myślących maszyn.

Siri to technologiczny obojnak - w zależności od wyboru języka przyjmuje głos mężczyzny lub kobiety, może być zatem wirtualnym asystentem lub asystentką. Siri nie jest ani samowystarczalna, ani samodzielna, wymaga stałego połączenia z internetem. Nie mając dostępnego pakietu danych lub nie będąc w zasięgu sieci bezprzewodowej, nie wykona dla nas nawet najprostszego polecenia, ba -nawet się nie uruchomi. Co więcej, technologia ta pełnię swoich możliwości pokazuje jedynie mieszkańcom wybranych krajów. Polacy mogą co najwyżej poprosić o wybranie numeru do żony lub włączenie konkretnej piosenki dostępnej już na iPhonie. Siri ma ponadto ogromne problemy z wyodrębnieniem naszego głosu i zrozumieniem w hałaśliwym otoczeniu.

Ograniczenia ograniczeniami, ale to właśnie system zainstalowany w iPhonie 4S ożywił tematykę sterowania głosowego w urządzeniach elektronicznych.

Butler-In-A-Box - czysta magia

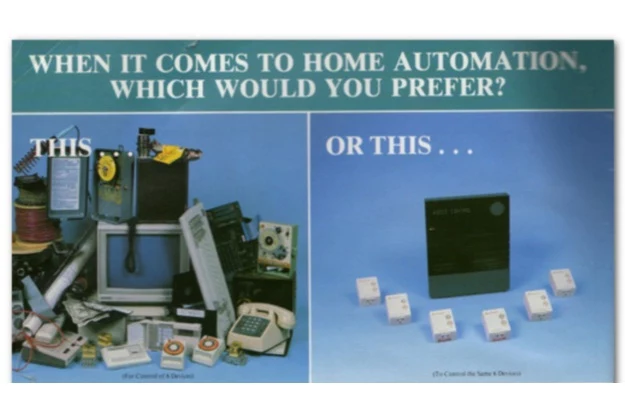

Pierwsze próby powołania do życia maszyn sterowanych głosem podejmowano już w połowie lat 80. XX wieku. Wtedy to magik Gus Searcy stworzył zaawansowaną jak na owe czasy technologię Butler-in-a-Box (BiB), która była wyjątkowo droga. BiB w założeniu twórcy miał być podstawowym wyposażeniem domów przyszłości. Zasada działania systemu opierała się na instalacji kilku czujników i modułów sterowania głosem w całym mieszkaniu. Dzięki temu użytkownik miał pełną kontrolę nad domową elektroniką - głosem mógł włączać światła, wykonywać proste polecenia i połączenia telefoniczne.

Ostatnie wcielenie BiB znacznie bardziej przypominało nowoczesny interfejs sterowany głosem, choć nawet mimo tego, technologii tej nie można postawić na równi z występującymi w filmach science fiction mówiącymi maszynami. Ze względu na wysokie koszty produkcji i cenę pojedynczego egzemplarza, BiB nie znalazł zbyt wielu zwolenników. Poza tym, podobnie jak w przypadku innych wspomnianych systemów, technologia Searcy'ego posiadała poważne ograniczenia. Do obsługi niezbędna była precyzyjna dykcja, specyficzne komendy, a przy tym system był w stanie zapamiętać głosy tylko dwóch stałych właścicieli.

Technologie Forda, Samsunga, ivee, Siri i BiB pozbawione są jednak kluczowego elementu niezbędnego do przeprowadzenia z maszyną naturalnej konwersacji: intuicji.

IBM Watson, o krok od HAL-a 9000

Wszystkie z nowoczesnych technologii wyposażone w interfejs sterowany głosem wyglądają jak zabawki przy stworzonym przez IBM superkomputerze Watson.

Watson wykorzystuje połączenie algorytmów do przetwarzania języka naturalnego, wyszukiwania informacji, reprezentacji wiedzy, wnioskowania i uczenia maszynowego. Superkomputer w obecnej postaci ma 2880 rdzeni, 15 TB pamięci RAM i, w przeciwieństwie do wymienionych wcześniej poprzedników, nie korzysta z połączenia z internetem.

Pierwsze wcielenie Watsona powstało w 2006 roku, jednak wkrótce potem rozpoczęto prace nad jego ulepszoną wersją. Watson ma swoją własną bazę danych zawierającą liczne słowniki, encyklopedie i dzieła literackie. Komputer IBM nie opiera się na jednym algorytmie, a używa ich setki, w dodatku równolegle działających, dzięki czemu błyskawicznie znajduje prawidłową odpowiedź na zadane pytanie.

Watson zdobył medialną popularność występując w popularnym teleturnieju "Jeopardy!" i regularnie pokonując najlepszych ludzkich graczy.

Jak Watson niszczy konkurencję:

Cybernetycy uważają, że Watson osiągnął nadspodziewanie wysoki poziom zaawansowania technologicznego, posiada zdolność logicznego i intuicyjnego łączenia niepowiązanych informacji w celu uzyskania pełnej i naturalnej odpowiedzi. Innymi słowy, Watson "rozumie".

IBM rozpoczął współpracę z Nuance Communications Inc., w ramach której Watson został wyposażony w umiejętność rozpoznawania mowy i wiedzę, pozwalającą zastosować go w diagnostyce medycznej. Przy pomocy lekarzy z Columbia University i University of Maryland badane są możliwości wykorzystania tej technologii w praktyce. Pierwsze komercyjne zastosowania mają pojawić się na przełomie 2012 i 2013 roku.

Watson może być tym dla świata, czym wynaleziony przed 136 laty przez Alexandra Bella telefon.

Ostatnie pytanie

Kształt sztucznej inteligencji, która prędzej czy później powstanie, jest jedynie źródłem spekulacji naukowców i futurologów. Komputery potrafią coraz więcej, a projekty takie jak Siri, Sync czy przede wszystkim IBM Watson, pokazują, że najwyższy stopień ewolucji maszyn wciąż czeka na odkrycie.

Jedna z najbardziej niezwykłych form przyszłej komunikacji ludzi z maszynami. została przedstawiona w powstałym w 1956 roku opowiadaniu "Ostatnie pytanie" autorstwa Isaaca Asimova, do zapoznania z którym gorąco zachęcam.