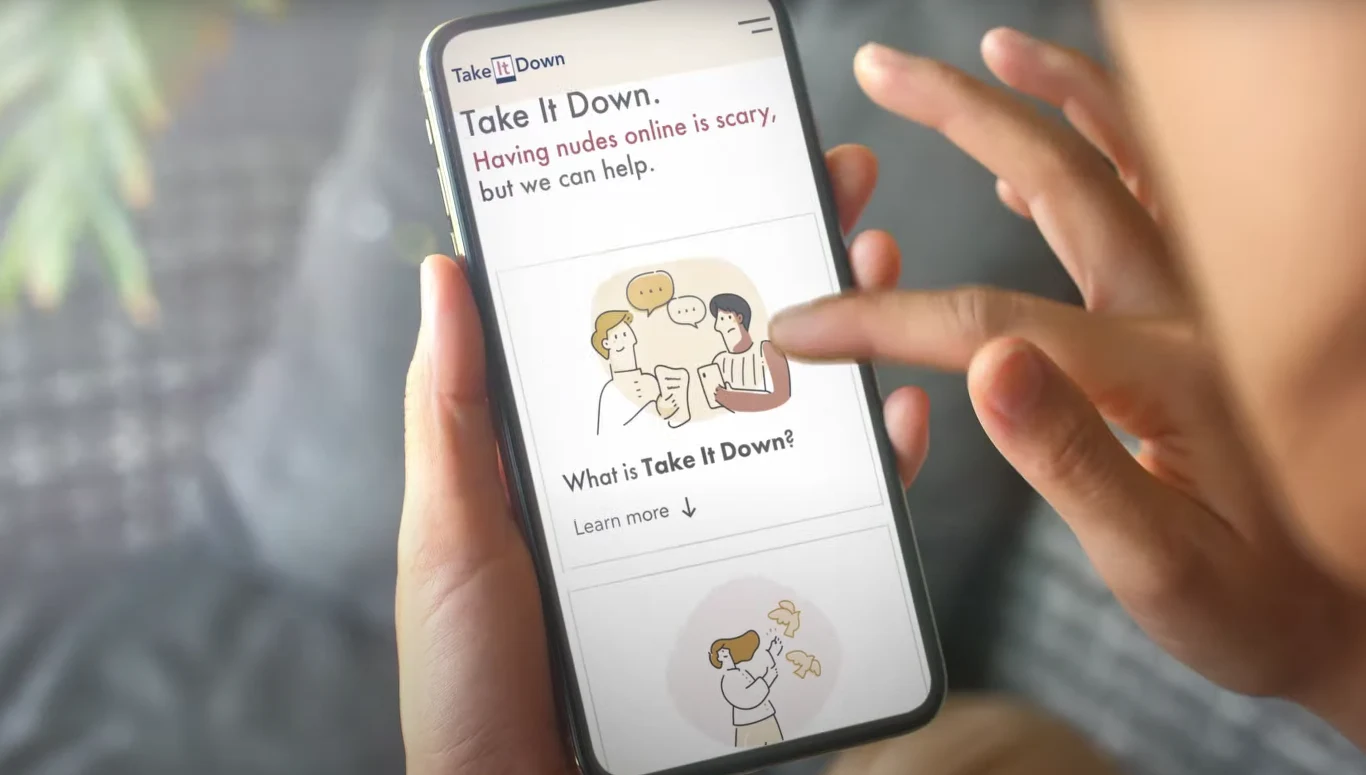

Przede wszystkim chronić. Take It Down usunie wrażliwe zdjęcia nieletnich z sieci

W 2020 roku na Facebooku i Instagramie znaleziono ponad 20 milionów materiałów przedstawiających wykorzystywanie seksualne dzieci. Problem istnieje i jest bardzo poważny. Istotnym jest znalezienie możliwie jak największej liczby sposobów, aby z nim walczyć. Rozwiązanie zaprezentowało National Center for Missing & Exploited Children — jest nim strona Take It Down.

Take It Down to narzędzie, jakie ma ograniczyć rozprzestrzenianie się tego typu treści. Platforma pozwoli użytkownikom anonimowo zgłaszać i usuwać nagie, częściowo nagie lub wyraźnie nieodpowiednie zdjęcia i filmy dzieci w wieku poniżej 18 lat, jakie zostały opublikowane w internecie i zablokować takie treści przed ponownym udostępnieniem. Narzędzie to jest przeznaczone dla osób niepełnoletnich do samodzielnego zgłaszania zdjęć i filmów, jednak może też być używane przez osoby powyżej 18 roku życia do usuwania fotografii zrobionych w czasie, gdy były one nieletnie. Zgłoszenia mogą też dokonywać rodzice lub zaufane osoby dorosłe. Take It Down ma być darmowe i dostępne na całym świecie.

Aby usunąć materiały z konkretnych portali współpracujących z Take It Down, użytkownik powinien na swoim urządzeniu oznaczyć zdjęcia oraz filmy, które nie mają znaleźć się w sieci lub już się tam znalazły. Take It Down wygeneruje specjalne oznaczenie i przypisze je do konkretnej treści, aby następnie pomóc zidentyfikować wszelkie kopie materiałów.

Co jednak ze zmodyfikowanymi materiałami?

Rozwiązanie to brzmi dobrze, jednak niestety nie jest idealne i są co do niego zastrzeżenia. Jak podaje The Associated Press, gdy ktoś przekształci obraz (np. poprzez jego przycięcie lub przekształcenie w mem), staje się on nową fotografią, wymagającą ponownego oznaczenia. No i oczywiście pozostaje kwestia tego, jak wiele portali będzie współpracowało z usługą — te, które nie będą chciały się zapisać, będą mogły przechowywać zdjęcia, które chcielibyśmy usunąć.

By opracować tę platformę i pomóc młodym ludziom uzyskać zasoby, których potrzebują w obliczu tych przerażających sytuacji, Meta współpracowała z NCMEC, ekspertami oraz ofiarami. Czekamy na inne firmy technologiczne, które dołączą do tego wysiłku, abyśmy mogli wspólnie walczyć z tym problemem w całym internecie

Dlaczego wkład Mety jest tak podkreślany? W 2019 roku firma ta zarejestrowała więcej materiałów dotyczących wykorzystywania seksualnego dzieci na swoich platformach niż jakakolwiek inna firma technologiczna i była odpowiedzialna za 99 procent zgłoszeń do NCMEC w tym czasie. Wykryła też ponad 20 milionów zdjęć dotyczących wykorzystywania seksualnego dzieci na Facebooku i Instagramie w 2020 roku.

Jak czytamy w raporcie przygotowanym przez New York University Stern Center for Business and Human Rights, w zespole moderatorów Facebooka i Instagrama pracuje około 15 tysięcy osób z całego świata. I choć może się to wydawać sporą liczbą, badaczka mediów społecznościowych z Uniwersytetu Syracuse określiła ją jako żałośnie nieadekwatną. Jak zaznaczyła, aby uzyskać faktycznie bezpieczniejsze media społecznościowe, potrzeba o wiele więcej moderatorów. Kierownik ds. komunikacji w Meta, Mitch Henderson, powiedział, że Take It Down działa obecnie także w ramach niezaszyfrowanych wiadomości na Messengerze i Instagramie.

Nie tylko Meta. Inne platformy również współpracują z NCMEC

Oprócz Mety, innymi platformami, jakie współpracują z NCMEC są PornHub, OnlyFans, MindGeek i Yubo. Co istotne, wszystkie pięć platform uczestniczących w programie było wcześniej krytykowane za brak ochrony nieletnich przed wykorzystywaniem seksualnym. Raport BBC News z 2021 roku wykazał, że dzieci mogły łatwo ominąć system weryfikacji wieku na OnlyFans, natomiast w samym 2021 roku PornHub został pozwany przez 34 ofiary wykorzystywania seksualnego. W zarzutach widniało przeświadczenie, że strona świadomie czerpała zyski z filmów przedstawiających gwałt i wykorzystywanie seksualne dzieci.