Najnowszy robot z MIT nie tylko widzi, ale i czuje. Poznajcie robota przyszłości

Wygląda na to, że sztuczna inteligencja wyposażona w zmysł dotyku będzie przyszłością robotyki, bo coraz częściej naukowcy prezentują nam takie właśnie rozwiązania, których możliwe zastosowania trudno zliczyć.

Niedawno pisaliśmy Wam o zaprezentowanej podczas Amazon re:MARS Tech Showcase robotycznej ręce ze zmysłem dotyku, która potrafi rozpoznawać różne tekstury, dźwigać do 5 kilogramów i może być sterowana zdalnie. Jej twórcy twierdzą, że może ona zrewolucjonizować wiele branż, choćby medycynę czy wojskowość, bo nietrudno wyobrazić sobie zastosowanie tej technologii podczas skomplikowanych procedur medycznych czy też rozbrajania bomb, dzięki czemu ludzie nie musieliby narażać swojego życia.

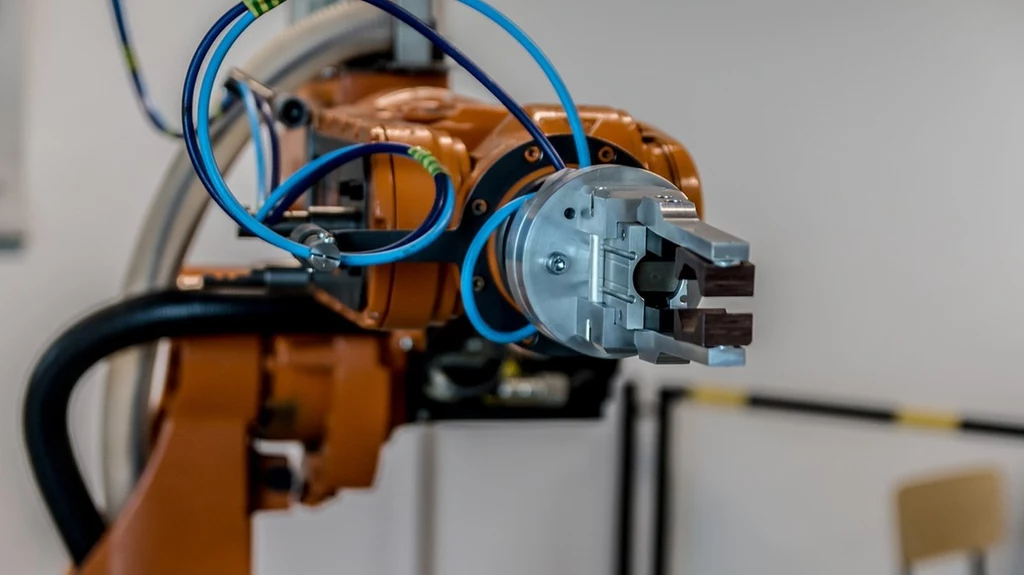

Dziś dowiadujemy się zaś o robocie stworzonym przez zespół z Massachusetts Institute of Technology, który rozpoznaje przedmioty za pomocą wzroku i dotyku właśnie. Bo choć dla nas, ludzi, jest to naturalne, że dobrze wiemy, jaki w dotyku będzie obiekt, na który patrzymy albo jak wygląda obiekt, którego dotykamy, to dla maszyn jest to ogromna przeszkoda. W tym konkretnym przypadku też zaczęło się od robotycznej ręki, o nazwie KUKA, do której dodano sensor dotyku GelSight.

Dane zebrane przez sensor są następnie przekazywane AI, żeby to mogło się nauczyć związków pomiędzy informacjami wizualnymi i dotykowymi. Oczywiście jak zawsze w przypadku sztucznej inteligencji, potrzeba mnóstwa materiałów szkoleniowych, dlatego zespół nagrał 12 tysięcy filmów, podczas których dotykanych jest 200 różnych obiektów, jak materiały, narzędzia czy urządzenia domowego użytku. Te następnie zostały pocięte na obrazy, na których AI mogło trenować, łącząc dane dotykowe z wizualnymi.

Jak twierdzi Yunzhu Li z Computer Science and Artificial Intelligence Laboratory (CSAIL): Patrząc na scenę, nasz model potrafi sobie wyobrazić uczucie dotykania płaskiej powierzchni albo ostrej krawędzi. Przez dotykanie w ciemno, może jedynie polegać na informacjach z tego sensora, które znowu są niepełne. Dopiero połączenie tych sensorów daje robotowi nowe możliwości, znacznie ograniczając czas potrzebny na rozpoznanie. Oczywiście jak na razie robot identyfikuje jedynie obiekty w kontrolowanym otoczeniu, ale naukowcy wierzą, że jeśli uda im się zbudować odpowiednio dużą bazę danych szkoleniowych, jego możliwości znacznie się zwiększą i wyjdą poza określony obszar treningowy.

Źródło: GeekWeek.pl/engadget