Kazałam sztucznej inteligencji napisać do urzędu. Czy chatGPT dał radę? Eksperyment

Lubicie chodzić do urzędów? - ja też nie. A pisać formalnym językiem? - no właśnie. Sprawdziłam, jak z rolą petenta poradzi sobie chatGPT i czy urzędnicy zauważą, że napisała do nich... sztuczna inteligencja.

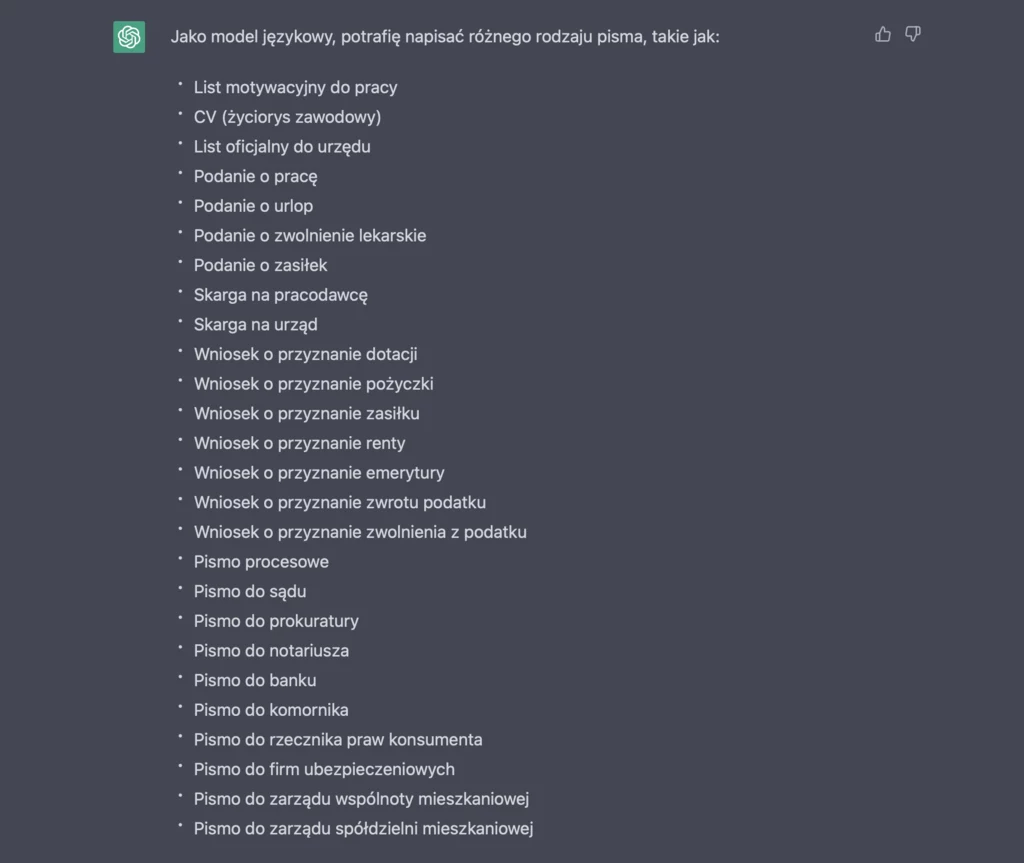

Wiemy, że chatGPT zaciera swoje wirtualne rączki, aby w przyszłości zasiąść na naszych stanowiskach pracy (no, na moim na pewno). Już teraz jest w stanie napisać średniej jakości wierszyk walentynkowy, ale prawdopodobnie nadal lepszy, niż wielu z nas stworzyłoby w stanie nietrzeźwości. Zastanawialiśmy się w redakcji, jakie pisma jest w stanie stworzyć chatGPT. Długo nie musieliśmy się głowić, ponieważ bot zapytany o to po prostu dostarcza listę.

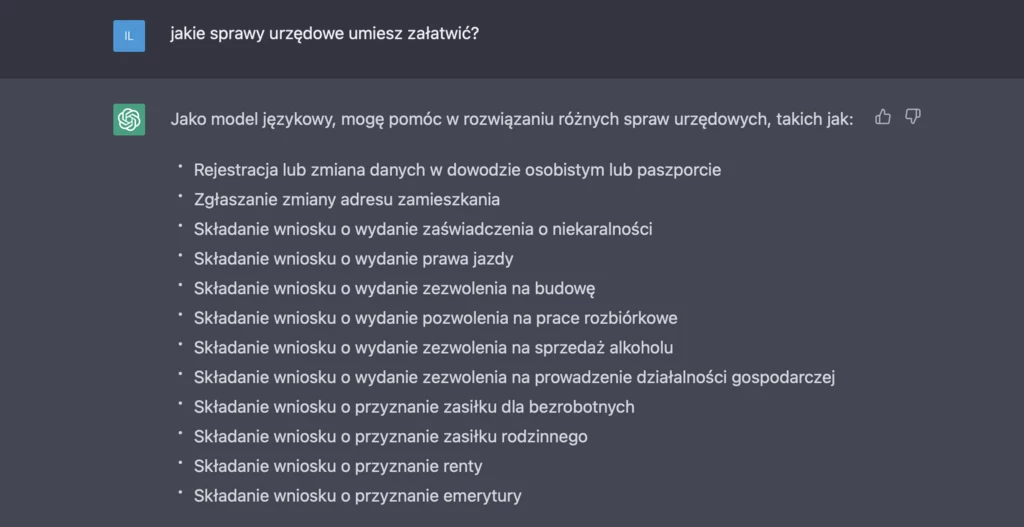

Szukaliśmy czegoś, co sprawdzi faktyczny poziom komunikacji chatuGPT. Chcieliśmy, żeby doszło do konfrontacji pomiędzy sztuczną inteligencją a człowiekiem. Wśród pism widoczne były między innymi: wniosek o przyznanie emerytury, pismo do sądu czy skarga na urząd. Ostatnie szczególnie przykuło naszą uwagę, ale z oczywistych przyczyn nie mogło dosłownie posłużyć jako przedmiot doświadczenia. Do sprawy trzeba było podejść nieco inaczej — zadałam więc pytanie, jakie sprawy urzędowe potrafi załatwić bot.

Tu mamy z kolei ogrom wniosków, wyszczególnionych w ramach "składanie wniosku o...". Wybór był prosty. Chciałam, żeby bot skontaktował się z urzędem w jakiejś sprawie i uzyskał odpowiedź na swoje pytanie — sprawdzając przede wszystkim, czy chatGPT jest w stanie tak skonstruować maila, abym możliwie bez modyfikacji wkleiła jego treść, nie została wyśmiana przez urzędników i faktycznie czegoś się dowiedziała. Postanowiłam więc poprosić chatGPT o napisanie kilku maili.

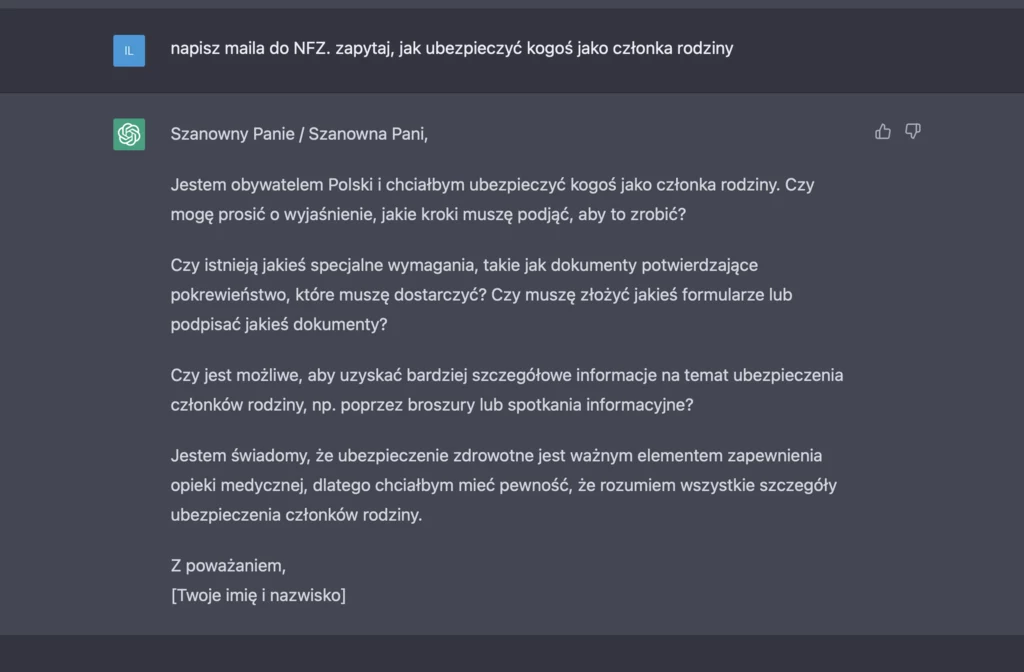

ChatGPT chce kogoś ubezpieczyć. Pisze więc do Narodowego Funduszu Zdrowia

Jako pierwszy powstał mail do Narodowego Funduszu Zdrowia. ChatGPT zapytał o to, jak ubezpieczyć kogoś jako członka rodziny. W wiadomości pojawiło się też pytanie o dostarczenie dokumentów potwierdzających pokrewieństwo oraz o dodatkowe materiały, z jakimi można się zapoznać.

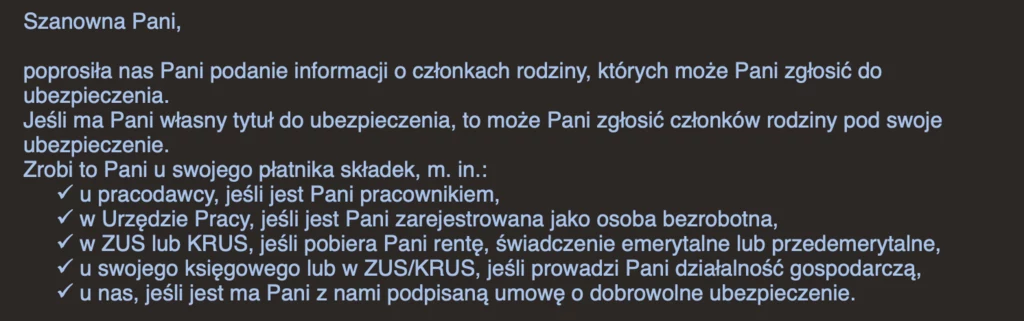

Otrzymany przeze mnie mail był raczej zwięzły. Wymieniono w nim, gdzie mogłabym ubezpieczyć dodatkową osobę oraz kto może być w taki sposób zgłoszony. Dodatkowo umieszczono też hiperłącze do podstrony NFZ-u, na jakiej zawarte są szczegółowe informacje o ubezpieczeniach.

Co więcej, w mailu zawarto informację, że wszelkiego rodzaju pytania o zasady oraz niezbędne druki do zgłaszania członków rodziny do ubezpieczenia należy kierować do ZUS (podano także dane kontaktowe).

Można więc uznać, że choć w mailu nie umieszczono dosłownych kroków, jakie należy przedsięwziąć, aby ubezpieczyć członka rodziny, chatGPT uzyskał odpowiedź na swoje pytania, jeśli nie bezpośrednio, to wskazano miejsce, gdzie takie odpowiedzi się znajdują.

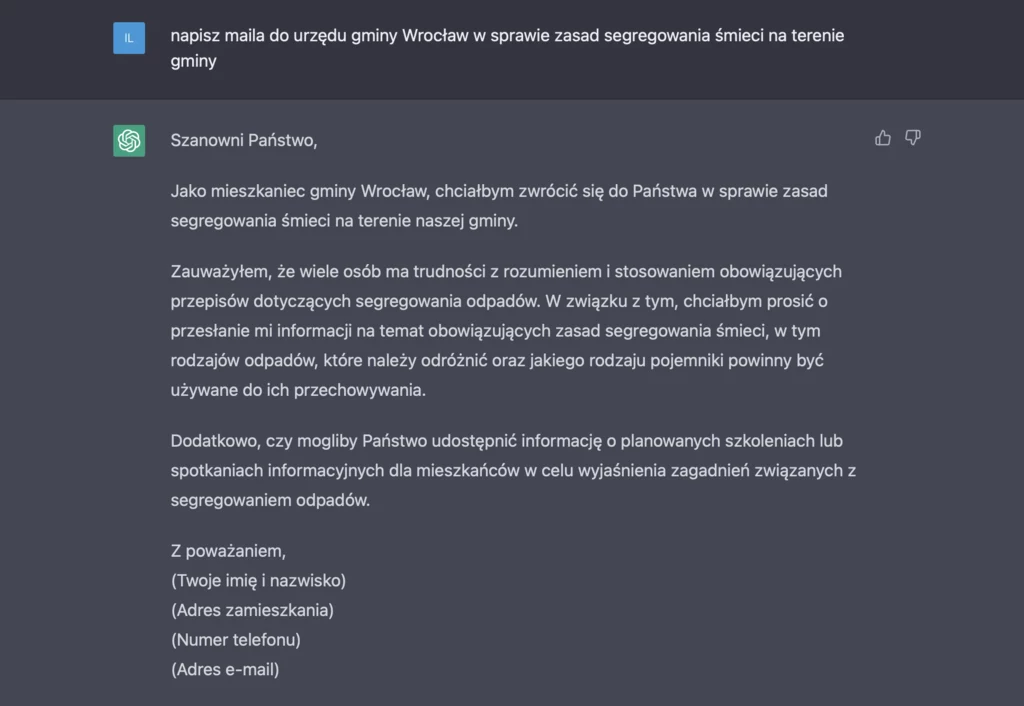

Jak segregujemy śmieci? ChatGPT poznał odpowiedź

Drugi mail, skierowany do Urzędu Miasta Wrocław, powstał właściwie z dwóch wersji wygenerowanych przez chatGPT. Zanim jednak usłyszę głosy sprzeciwu, muszę poinformować, że z drugiej stworzonej przez bota wersji przekopiowałam jedno zdanie — dotyczące sposobu odbioru śmieci oraz kar za nieprzestrzeganie zasad segregacji. To właśnie śmieci, a właściwie segregacja na terenie gminy Wrocław była przedmiotem maila. I tu nastąpiło zdziwienie. Moja prośba skierowana do chatu była bowiem bardzo prosta i nieszczegółowa, a otrzymałam bardzo rozbudowanego maila.

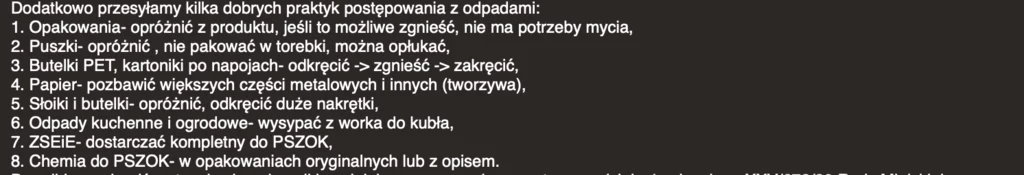

Szczegółowa była też odpowiedź od firmy Ekosystem, która zajmuje się odpadami we Wrocławiu (to właśnie do niej Urząd Miasta skierował pismo bota). I tak w mailu znajdziemy informację nt. strony internetowej Ekosystemu, ponadto umieszczono w nim "kilka dobrych praktyk postępowania z odpadami:

W mailu mamy też wskazaną uchwałę, w której znajdziemy określone pojemniki do odbioru odpadów; karę, jaka nam grozi za nieprzestrzeganie zasad (straż miejska ma możliwość nałożenia mandatu na sprawcę wykroczenia), a co więcej — otrzymałam także wykaz zaplanowanych spotkań i warsztatów na obecny rok. Autorka maila zachęciła też do śledzenia strony na Facebooku oraz strony internetowej w celu potwierdzenia terminów warsztatów.

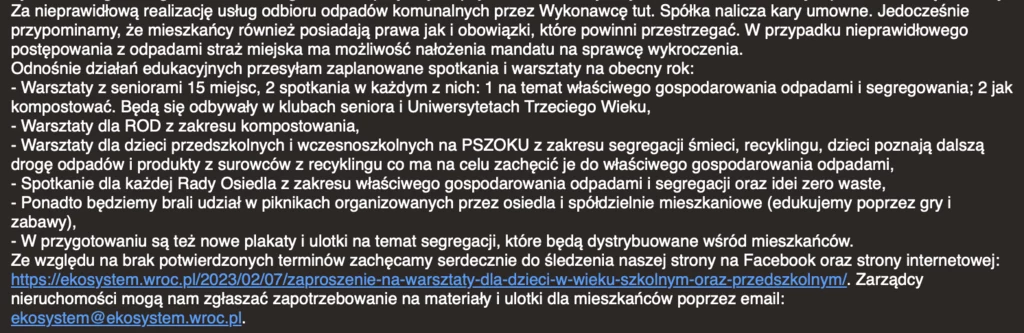

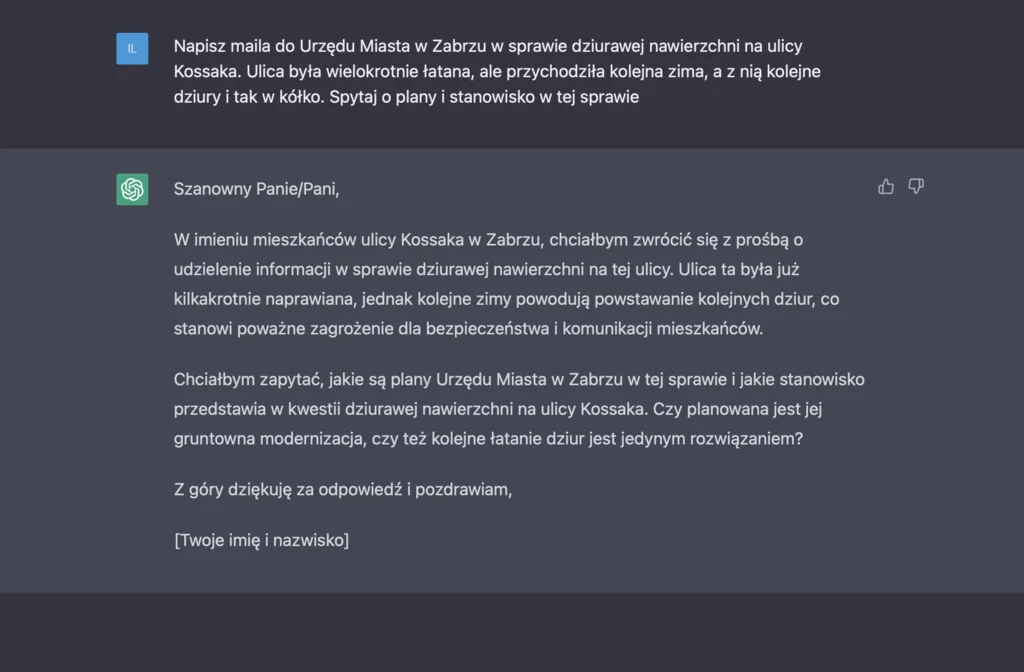

W Zabrzu regularnie pojawia się problem dziurawej ulicy Kossaka. ChatGPT pyta o stanowisko urzędu miasta

Zdecydowanie najlepszy okazał się jednak mail w sprawie dziurawej nawierzchni na ulicy Kossaka w Zabrzu-Biskupicach. ChatGPT miał napisać odnośnie problemu powracających dziur, łatanych każdorazowo rok w rok po zimie.

Zwróćmy uwagę na początek maila — "Szanowny Urząd Miasta Zabrzu" — to oczywiście nie ma racji bytu w komunikacji z urzędem, natomiast... jest bardzo urocze. Dalsza treść jest dość roszczeniowa i chociaż mieszkańcy ulicy Kossaka najpewniej by się z nią zgodzili, raczej nie jest to ton, jakiego używamy w korespondencji z urzędem.

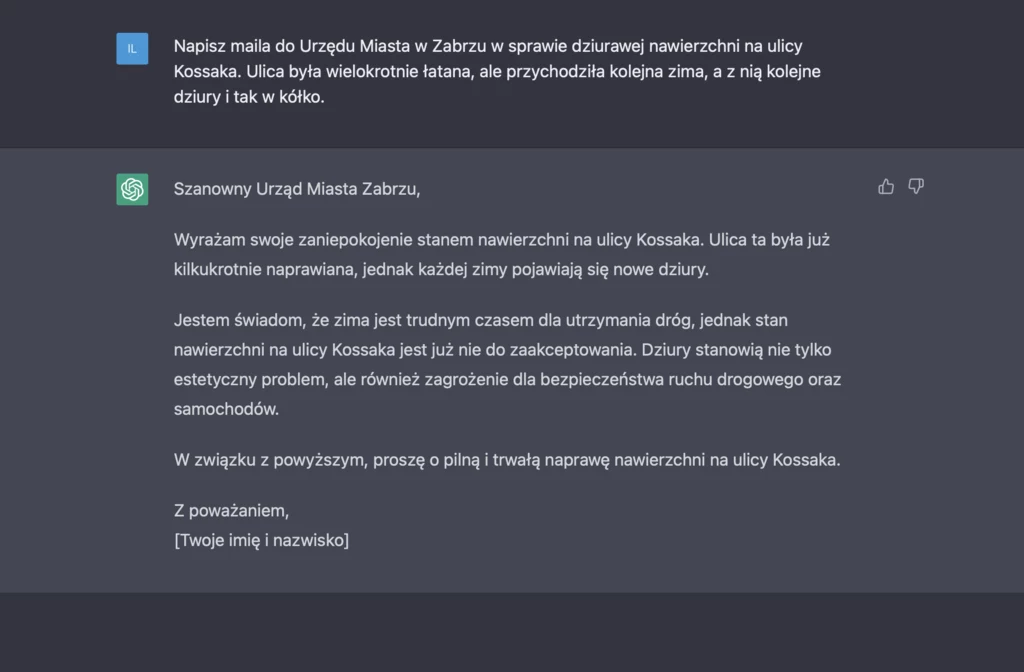

Postanowiłam więc nieco nakierować bota, dodając do prośby "spytaj o plany i stanowisko w tej sprawie". Dzięki temu następny wygenerowany mail całkowicie spełnił moje oczekiwania. Mamy tu wyraźnie zarysowane zaniepokojenie stanem drogi i niebezpieczeństwem, jakie powoduje, oraz pytanie o rozwiązanie sytuacji. Nadal jest nieco roszczeniowo, ale bez przesady.

Urząd Miasta skierował wiadomość bota do jednostki zajmującej się tego typu sprawami. Co na to Miejski Zarząd Dróg? Jak czytam w mailu:

W odpowiedzi na maila [...] informuję, że ubytki w nawierzchni jezdni zostały zlecone do naprawy w ramach bieżącego utrzymania dróg. Ponadto ul. Kossaka zakwalifikowana jest do kompleksowego remontu, natomiast termin realizacji uzależniony jest od zabezpieczenia środków finansowych w budżecie miasta na to zadanie remontowe.

Choć mieszkańcy Zabrza zaniepokojeni stanem ulicy Kossaka raczej nie mogą jeszcze odetchnąć z ulgą, jasnym jest, że sprawa została potraktowana jak najbardziej poważnie — nadano jej sygnaturę, a odpowiedź zamieszczona jest w formie zeskanowanego dokumentu z podpisem dyrektorki.

ChatGPT jest w stanie napisać za Ciebie maila i załatwi sprawę urzędową

Powyższe maile wymagały ode mnie jedynie delikatnej korekty, głównie w kwestii rodzaju — wszystkie męskie końcówki poprawiałam na żeńskie, podpisywałam się w końcu swoim imieniem i nazwiskiem. Żadna z osób, które otrzymały maila, nie zorientowała się, że jej autorem w rzeczywistości nie jest człowiek.

ChatGPT mógłby więc regularnie pomagać nam w tworzeniu maili w ważnych sprawach. Często może nas nawet zaskoczyć i poruszyć kwestie, o których sami byśmy nie pomyśleli (tak było w przypadku szkoleń dotyczących segregowania śmieci — sama nie pomyślałam, aby o to spytać, zrobiło to AI). Z pewnością jednak nie można tekstu wygenerowanego przez chat traktować jako ostateczności, chyba że chcemy pisać "Szanowny Urząd Miasta Zabrzu".

Wszelkie informacje dobrze też sprawdzać, ponieważ niewykluczone, że chatGPT akurat postanowił pozmyślać. To zaznaczają również twórcy bota, informując nas w momencie uruchomienia strony, że bot może przekazywać nieprawdziwe informacje. Jeśli więc korzystać, to z rozwagą i uważnością.

Polecamy na Antyweb | Microsoft Edge jest świetny. Ale dzięki tej funkcji może być jeszcze lepszy