Instagram zaalarmuje rodziców, gdy nastolatek szuka nieodpowiednich treści

Meta ogłosiła wprowadzenie nowej funkcji na Instagramie, która powiadamia opiekunów o niepokojących zachowaniach nastolatków. Jeśli młody użytkownik w krótkim odstępie czasu kilkukrotnie wpisze w wyszukiwarkę frazy związane z samobójstwem lub samookaleczeniem, rodzic korzystający z narzędzi nadzoru w "Centrum Rodzinnym" otrzyma natychmiastowy alert z dostępem do profesjonalnych zasobów pomocowych. Nowość ma na celu wspieranie rodziców w chronieniu zdrowia i dobrostanu dzieci. Nie obyło się jednak bez kontrowersji.

Spis treści:

- Nowa funkcja Instagrama zaalarmuje rodziców nastolatków

- Eksperci od bezpieczeństwa dzieci chwalą nowe rozwiązanie Mety

- Funkcja ma pewne ograniczenia. Meta planuje też monitorować czatboty AI

Nowa funkcja Instagrama zaalarmuje rodziców nastolatków

Nowa funkcja na Instagramie zakłada aktywne informowanie opiekunów o niepokojących zachowaniach nastolatków. Gdy nastolatek w krótkim odstępie czasu będzie kilkukrotnie wyszukiwał frazy związane z samobójstwem lub autoagresją, platforma natychmiastowo zaalarmuje opiekuna korzystającego z narzędzi nadzoru w "Centrum Rodzinnym".

Instagram już wcześniej blokował takie wyszukiwania i przekierowywał osoby do linii wsparcia. Teraz system idzie o krok dalej, angażując bezpośrednio opiekunów poprzez powiadomienia SMS, wiadomości w aplikacji lub na platformie WhatsApp.

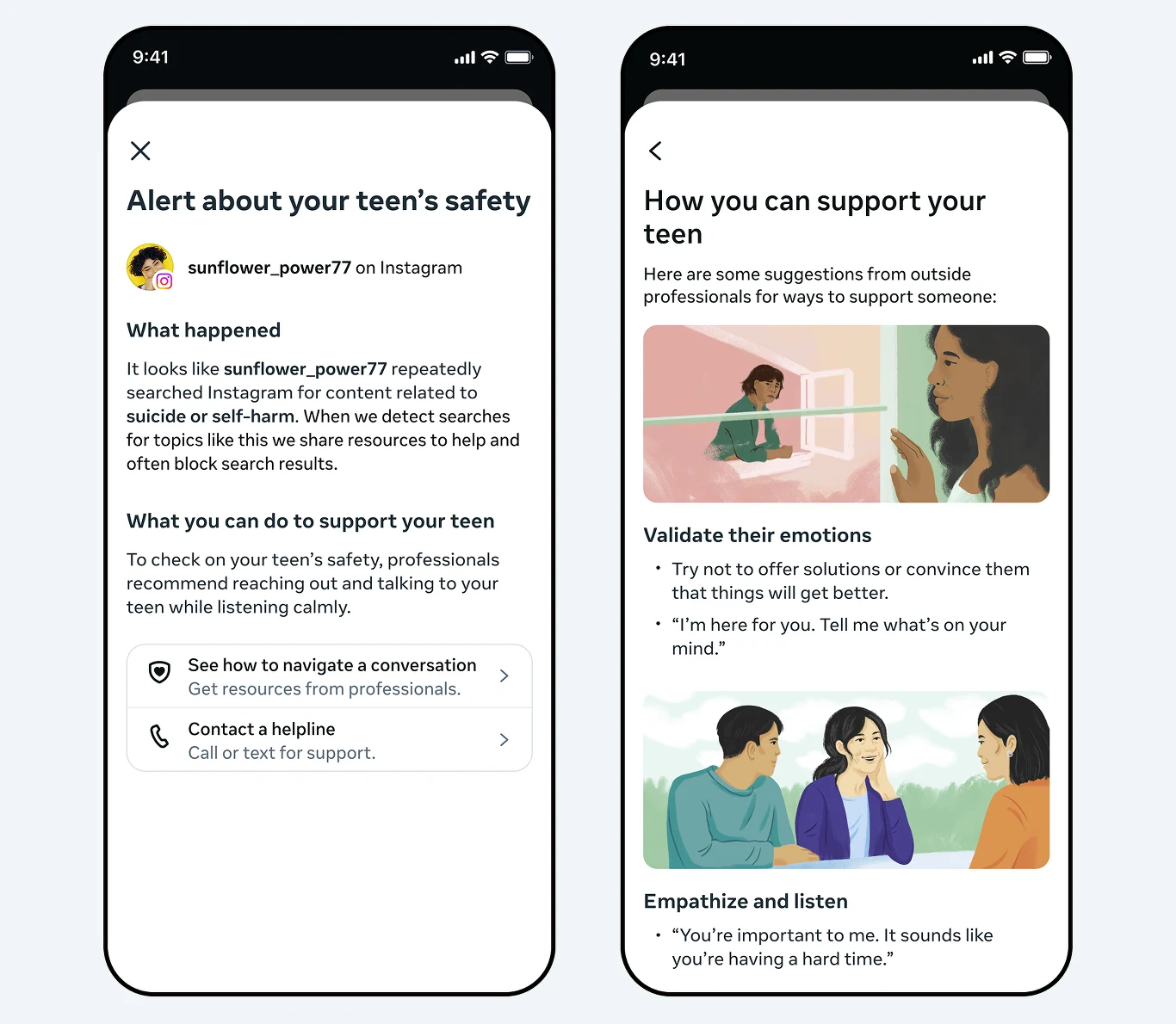

"Rozumiemy, jak wrażliwe są te kwestie i jak stresujące dla rodzica może być otrzymanie takiego alertu. Większość nastolatków nie stara się szukać treści związanych z samobójstwem i samookaleczeniem na Instagramie, a kiedy to robią, naszą zasadą jest blokowanie tych wyszukań i zamiast tego przekierowanie ich do zasobów i linii pomocy, które mogą udzielić wsparcia. Te alerty zostały zaprojektowane, by zapewnić, że rodzice są świadomi, że ich nastolatek wielokrotnie stara się wyszukać takie treści, oraz by dać im zasoby, których potrzebują, by wspierać swojego nastolatka" - wyjaśnia Meta.

Jak dokładnie działa ten system ostrzegania? Po powtarzającej się próbie wyszukania alarmujących fraz przez nastolatka na urządzenie rodzica trafi powiadomienie. Po jego stuknięciu rodzice zobaczą pełnoekranowy komunikat zawierający zasoby przygotowane przez ekspertów. Materiały te mają pomóc w zainicjowaniu trudnej rozmowy i udzieleniu dziecku odpowiedniego wsparcia psychologicznego.

Nowość ma zadebiutować w marcu w Stanach Zjednoczonych, Wielkiej Brytanii, Australii i Kanadzie, a w kolejnych miesiącach jej dostępność dalej się rozszerzy.

Eksperci od bezpieczeństwa dzieci chwalą nowe rozwiązanie Mety

"Kluczowe jest to, że rodzice mają potrzebne informacje, aby wspierać swoich nastolatków. To naprawdę ważny krok, które powinien pomóc w zapewnieniu rodzicom większego spokoju ducha - jeśli ich nastolatek aktywnie szuka tego typu szkodliwych treści na Instagramie, dowiedzą się o tym" - skomentowała Vivki Shotbolt, CEO Parent Zone.

Nowość na Instagramie pochwalił także dr Sameer Hinduja, współdyrektor Cyberbullying Research Center. "Kiedy młoda osoba szuka informacji o samobójstwie lub samookaleczaniu, udzielenie rodzicom wsparcia w interwencji może być niezwykle ważne. Fakt, że Meta wbudowała to teraz, jest znaczącym krokiem naprzód i tym rodzajem zmiany, na którą naciskali eksperci od bezpieczeństwa dzieci" - skomentował ekspert.

Meta podkreśla, że mimo restrykcyjnej polityki usuwania treści promujących i przedstawiających autoagresję, dozwolone jest udostępnianie treści osób, które opisują swoje zmagania z tym problemem. Treści te są jednak ukrywane przed nastolatkami, nawet gdy udostępniają je obserwowani przez nich użytkownicy.

Firma zaznacza też, że system został skalibrowany tak, aby unikać nadmiernego wysyłania alertów, co mogłoby doprowadzić do ich ignorowania. Wybrany próg kilku wyszukiwań w krótkim czasie ma stanowić balans między ostrożnością a użytecznością narzędzia.

Funkcja ma pewne ograniczenia. Meta planuje też monitorować czatboty AI

Nowe rozwiązanie, choć chwalone przez ekspertów, niesie ze sobą pewne ograniczenia. Mechanizm będzie działał wyłącznie na kontach, na których aktywowano narzędzia nadzoru rodzicielskiego, co wymaga zgody obu stron - zarówno rodzica, jak i nastolatka. Oznacza to, że funkcja może nie objąć dzieci, które celowo ukrywają swoją aktywność online przed opiekunami.

Co dalej? Meta planuje rozszerzyć ten system na interakcje z czatbotami AI, co rodzi nowe pytania o prywatność nastolatków oraz o sposób, w jaki sztuczna inteligencja będzie interpretować i raportować rozmowy.

Funkcja związana z bezpieczeństwem dzieci pojawia się w ciekawym momencie, bo tuż po głośnych zeznaniach dyrektora generalnego Instagrama, Adama Mosseriego, który podczas procesu dotyczącego uzależnienia od mediów społecznościowych wzbudził falę krytyki stwierdzeniem, że nie postrzega nadmiernego czasu przed ekranem jako klinicznego uzależnienia. Publiczny odbiór tej wypowiedzi był negatywny, a firmie zarzucono przedkładanie zysków nad dobrostan użytkowników.

W tym samym czasie Mark Zuckerberg składał wyjaśnienia w sądzie w sprawach dotyczących wpływu platform Meta na zdrowie psychiczne młodzieży, co sprawia, że czas nowego ogłoszenia jest przez wielu postrzegany jako próba poprawy wizerunku korporacji w oczach ustawodawców.

Mimo dyskusji wokół motywacji Mety eksperci są zdania, że każda dodatkowa warstwa chroniąca młodych ludzi przed zagrożeniami jest krokiem w dobrym kierunku.

![Wstyd nie znać tych faktów o naszej historii. 6/10 to dobry wynik [QUIZ]](https://i.iplsc.com/000MJN1BW51N740M-C401.webp)