Sztuczna inteligencja robi niewiarygodne rzeczy w wyszukiwarce Google

Na konferencji Google I/O 2025 zaprezentowano sporo nowości związanych ze sztuczną inteligencją. To obecnie największy trend w całym świecie technologii. AI towarzyszy nam niemalże na każdym kroku, a jej funkcje zasilają kolejne usługi. Na ich czele stoi wyszukiwarka Google. Od lat obserwujemy jej ewolucję z wykorzystaniem sztucznej inteligencji, a ostatnio ten proces nabrał pędu, głównie za sprawą rozwoju modelu Google Gemini. Wyszukiwanie w internecie nigdy nie będzie już takie samo.

Spis treści:

- Przegląd od AI w Google robi wrażenie, ale Tryb AI idzie jeszcze dalej

- Asystent i agent AI wbudowany w wyszukiwarkę Google

- Multimodalna sztuczna inteligencja w Google. Jak to działa?

Przegląd od AI w Google robi wrażenie, ale Tryb AI idzie jeszcze dalej

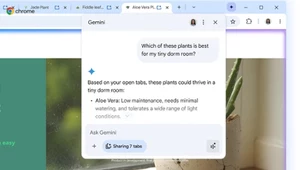

Na ostatniej edycji dorocznej konferencji Google I/O 2025 producent ogłosił, że funkcja AI Overviews zaliczyła "jeden z najbardziej udanych startów w Search w ostatniej dekadzie". Przegląd od AI to funkcja wyszukiwarki Google, która umieszcza odpowiedzi od sztucznej inteligencji tuż nad tradycyjnymi wynikami wyszukiwania. Dzięki temu użytkownicy mogą zadawać pytania bezpośrednio na pasku wyszukiwarki, bez potrzeby otwierania czatbotów na innych kartach.

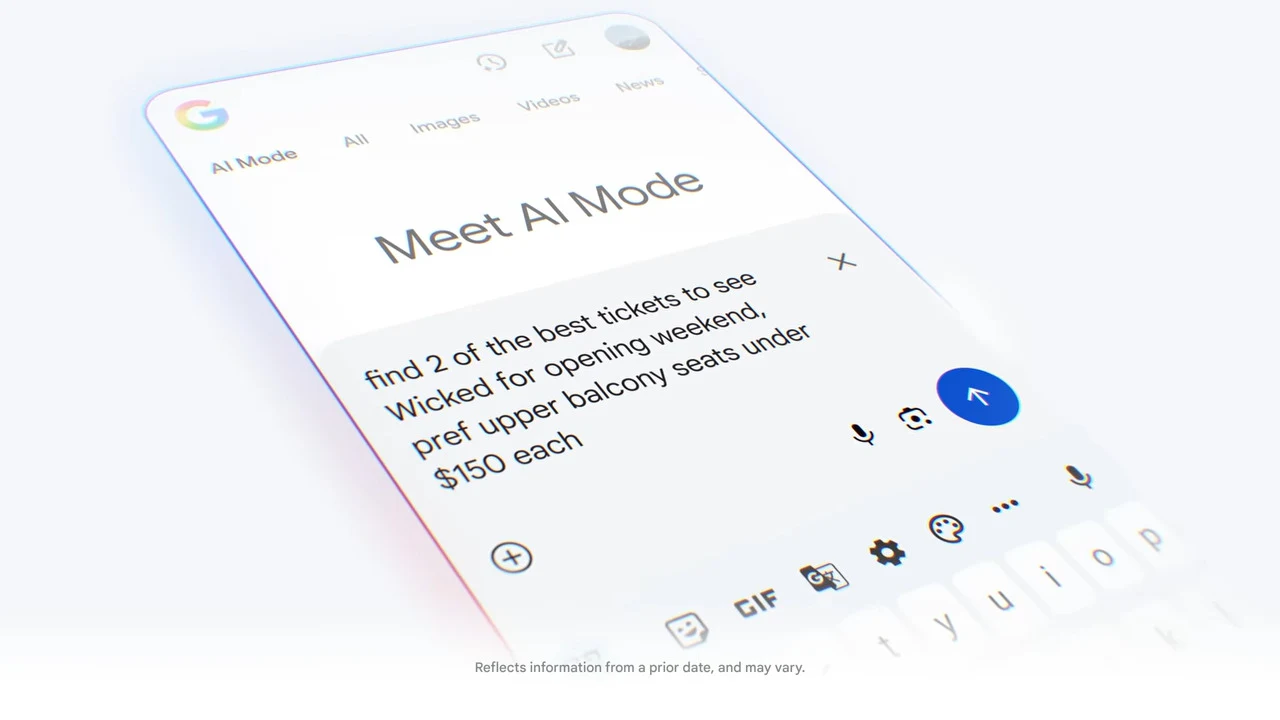

Google ogłosiło, że AI Mode zaczął być udostępniany wszystkim użytkownikom w USA. Nie jest już konieczne logowanie się w Google Labs. Mimo zbliżonej nazwy Tryb AI nie jest tym samym, co Przegląd od AI. Jak tłumaczy producent, AI mode dostarcza wygenerowane przez AI odpowiedzi na znacznie więcej zapytań oraz na bardziej złożone pytania w porównaniu do dzisiejszego AI Overviews. Wykorzystuje również bardziej zaawansowane modele - obecnie jest to specjalnie dostosowana wersja Gemini 2.5.

Przegląd od AI w Google dostarcza raczej szybkich i dość skondensowanych odpowiedzi, natomiast Tryb AI idzie o krok dalej. Google integruje go z trybem Deep Search, który - jak wskazuje sama nazwa - dużo głębiej bada temat. Sztuczna inteligencja wykonuje dziesiątki, a nawet setki wyszukań, aby odnieść się do wielu źródeł, porównać informacje, przedstawić różne punkty widzenia i wygenerować wyczerpujący raport (taki jak ten w odpowiedzi na nasze pytanie o to, kto wygra wybory). Na taką odpowiedź czekamy jednak dłużej, bo do kilka minut. Jeśli jednak pragniemy coś dogłębnie zbadać, warto tyle poczekać, zwłaszcza że nam samym jako ludziom taka praca zajęłaby nawet wiele godzin.

Asystent i agent AI wbudowany w wyszukiwarkę Google

Tryb AI w Google zacznie też być bardziej spersonalizowany. Dzięki temu, że będzie pamiętał nasze poprzednie zapytania, będzie mógł oferować na ich podstawie sugestie kolejnych. Jest to zgodne z obecnym trendem "bardziej osobistego asystenta", który uczy się stylu i sposobu wyszukiwania danego użytkownika. Niedawno takie funkcje pamięci i opartych na niej rekomendacji zapowiedziano dla asystenta Microsoft Copilot, z którym Google Gemini rywalizuje.

Bardziej osobisty AI Mode oznaczać będzie również możliwość połączenia usługi z innymi aplikacjami Google, takimi jak poczta Gmail. W ten sposób ta bezosobowa niegdyś sztuczna inteligencja w wyszukiwarce zyska większą świadomość kontekstu i będzie mogła zasugerować użytkownikowi wydarzenia w pobliżu w oparciu o zabukowane hotele czy loty. Niewykluczone też, że pojawi się integracja z kalendarzem. Najpewniej wszystko to pozostanie opcjonalne, jako że nie wszyscy chcą łączyć AI ze swoimi prywatnymi zasobami.

Sztuczna inteligencja w Google przyjmie również rolę agenta. Oprogramowanie tego typu jest w stanie wykonywać w imieniu użytkownika niektóre żmudne czynności w sposób autonomiczny, choć tylko do pewnego stopnia. Agent AI będzie mógł np. rezerwować bilety na wydarzenia czy stoliki w restauracjach. Użytkownik nie będzie już musiał przedzierać się przez wiele stron internetowych i formularzy. Rolą człowieka będzie wydanie polecenia, a następnie sprawdzenie tego, co proponuje AI Mode i zatwierdzenie (bądź odrzucenie lub modyfikacja) jego działania. Google ogłosiło na tym polu współpracę z Ticketmaster, StubHub, Resy i Vagaro.

Multimodalna sztuczna inteligencja w Google. Jak to działa?

Sztuczna inteligencja Google stanie się bardziej multimodalna (czyli w pewnym sensie multimedialna). W domenie AI oznacza to pracę na wielu rodzajach danych (m.in. tekście, obrazach i wideo) zarówno jeśli chodzi o dane wejściowe, jak i generowane wyniki. Firma zapowiedziała integrację funkcji spod szyldu Project Astra z Google Search. Podobnie jak w Gemini Live funkcjonalność Search Live umożliwi prowadzenie rozmów ze sztuczną inteligencją na temat tego, co widzi ona przez obiektyw aparatu w naszym telefonie.

AI Mode będzie sobie też lepiej radził z bardziej z analizą bardziej złożonych zestawów danych. Jeśli zaś chodzi o funkcje generatywne, będzie mógł tworzyć dla użytkowników własne, specjalnie dostosowane wykresy i interaktywne grafy, np. w odpowiedzi na pytania związane ze sportem i finansami. Wspomniana wcześniej multimodalność umożliwi też nowe doświadczenia związane z zakupami. O ile ChatGPT i Copilot mają wspomagać użytkowników przy zakupach, Google zamierza wejść na jeszcze wyższy poziom. Tryb AI będzie działać jak wirtualna przymierzalnia, tworząc wizualizacje tego, jak ubranie leży na użytkowniku.

Nowe, inteligentne funkcje wyszukiwarki Google mają zostać uruchomione w najbliższych tygodniach i miesiącach. Początkowo będą dostępne dla użytkowników eksperymentalnej platformy Google Labs. Dopiero po tych testach staną się ogólnodostępne. AI Mode - w odróżnieniu od AI Overviews - nie jest jeszcze dostępny w Polsce.