Fact-checking na Facebooku i Instagramie. To koniec dezinformacji?

Mark Zuckerberg często zmienia poglądy. Na początku tego roku szef Mety powiedział, że platforma pozbywa się zewnętrznych fact-checkerów, czyli pracowników, którzy weryfikują prawdziwość informacji w postach na Facebooku, Instagramie i Threads. Miało to rzekomo zapewnić większą "wolność słowa". Teraz firma ogłasza, że przekazuje to zadanie swoim użytkownikom. Meta wprowadzi funkcjonalność "Community Notes" na wzór tej stosowanej na platformie X. To koniec dezinformacji na Facebooku?

"Wolność ekspresji" to wartość, na którą Mark Zuckerberg powoływał się wiele razy w ciągu ostatnich lat. Często znaczyło to coś innego. Nic dziwnego - w końcu to szerokie pojęcie z dużą wolnością interpretacji, którego można użyć w zmieniających się warunkach politycznych i biznesowych. Co to dokładnie znaczy teraz, gdy Meta chce za darmo korzystać z usług użytkowników-weryfikatorów?

Facebook, Instagram i Threads stawiają na wewnętrzny fact-checking

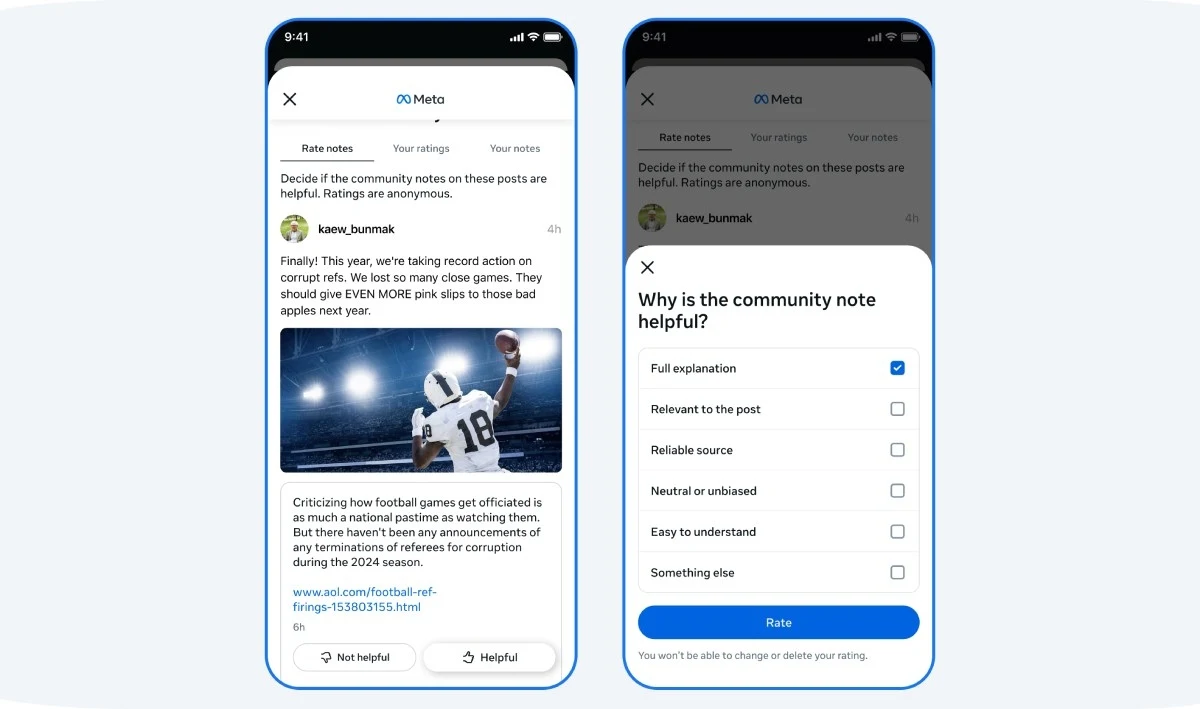

Platformy społecznościowe firmy Meta już za parę dni zaczną korzystać ze społecznościowego fact-checkingu. Pisane przez użytkowników uwagi oraz ich oceny zaczną pojawiać się na platformie 18 marca. Chętnych nie brakuje. Meta ujawnia, że na listę oczekujących zgłosiło się aż 200 tys. kontrybutorów, którzy chcą korzystać z Community Notes. Firma zacznie ich stopniowo wdrażać w proces, gdy funkcja zostanie wprowadzona. Pierwsze obsługiwane języki to angielski, hiszpański, chiński, wietnamski, francuski i portugalski. Może to oznaczać, że fact-checking w Polsce pojawi się nieco później.

Meta poinformowała, że początkowo będzie korzystać z tego samego open-source'owego algorytmu, który stosuje X. Oceny będą uwzględniać historię ocen każdego użytkownika, aby pomóc określić, które notatki pojawią się na platformie. Kwalifikujący się użytkownicy muszą mieć konto Meta od przynajmniej 6 miesięcy. Powinno ono mieć nieposzlakowaną opinię oraz zweryfikowany numer telefonu powiązany z kontem z aktywowanym uwierzytelnianiem dwuskładnikowym (2FA).

Fakt czy opinia? Społeczność zweryfikuje

W dyskursie publicznym mieszają się fakty, opinie, fake newsy, reklamy, a ostatnio nawet treści generowane przez AI i boty. Wszystko to w rękach sprawnych manipulatorów może szerzyć dezinformację i wpływać na nastroje społeczne (choćby przesądzić o wynikach wyborów). Wolność słowa pozwala użytkownikom wygłaszać subiektywne opinie, ale jeśli przemycają półprawdy albo fałszywe informacje, to należy je oddzielić grubą kreską i ujawnić. Kto ma prawo decydować, co jest prawdą, a co kłamstwem? Fact-checkerzy nie będą mieli pełnej autonomii. To raczej proces demokratyczny, w którym decydujący głos otrzyma społeczność. Koniec z "Ministerstwem Prawdy".

Meta zadecydowała, że zanim notatka fact-checkera zostanie opublikowana, musi uzyskać zatwierdzenie od użytkowników z "całym wachlarzem punktów widzenia". Nieważne, ilu kontrybutorów zaakceptuje notkę. Ujrzy ona światło dzienne dopiero, gdy ludzie, którzy "normalnie się nie zgadzają", uznają ją za przydatną. Nie wiadomo, czy dzięki temu uda się uniknąć pułapki subiektywizmu. Wszystkie notki muszą mieścić się w 500 znakach oraz zawierać link, który potwierdza jej treść.

Koniec dezinformacji? To może zadziałać, ale nie musi

Badanie przeprowadzone na University of Illinois Urbana-Champaign wykazało, że użytkownicy platformy X (dawniej Twitter) byli bardziej skłonni do wycofania fałszywych posty w odpowiedzi na notatki. Inne badanie, przeprowadzone w PNAS Nexus w zeszłym roku, pokazało z kolei, że notatki społeczności były postrzegane przez użytkowników jako znacznie bardziej wiarygodne niż flagi dezinformacji lub notatki od zewnętrznych fact-checkerów.

Pojawia się jednak kolejny problem. Notatki weryfikatorów stają się polem sporów, kłótni, tworzenia się grup wpływu i gamifikacji czy też grywalizacji. Wszystko to może sprawić, że przydatne komentarze mogą długo albo nawet nigdy nie ujrzeć światła dziennego. Trudno znaleźć równowagę między demokracją a merytokracją.

Badanie hiszpańskiej strony fact-checkingowej Matilda pokazało, że jedynie 8,3% proponowanych notek weryfikatorów treści na X ukazało się pod postami. Może to tłumaczyć, dlaczego na X jest jeszcze więcej dezinformacji, spamu i nienawistnych śmieci niż wcześniej na Twitterze, który przecież też nie miał dobrej opinii. Siewcy fake newsów na X zwyczajnie nie boją się zdemaskowania.

Nie wiadomo, czy Mecie uda się osiągnąć wysoki poziom zaufania po wprowadzeniu nowego mechanizmu weryfikacji. Pytanie, czy w ogóle jej zależy. Cały pomysł ze społecznościowym fact-checkingiem może być jedynie mydleniem oczu i wykorzystaniem darmowej siły roboczej użytkowników, by poprawić swój wizerunek. Meta umywa ręce - hej, w końcu to lud zdecydował.