Google i Samsung mają nowe funkcje AI. Kiedy trafią do Siri na iOS?

Samsung i Google ogłosili na scenie konferencji Galaxy Unpacked 2026 kolejny etap partnerstwa, prezentując zaawansowane funkcje sztucznej inteligencji zintegrowane z najnowszą serią smartfonów Galaxy S26. Za sprawą modeli z rodziny Gemini 3 system Android ewoluuje w inteligentne środowisko, które aktywnie uczy się nawyków użytkownika i wspiera go w codziennych wyzwaniach. Czegoś takiego nie było w stanie osiągnąć Apple ze swoją Siri, ale także jemu z pomocą przychodzi Google AI.

Spis treści:

- Google Gemini załatwi twoje sprawy w tle na Samsungu

- Wyszukiwanie obrazem i wirtualne przymierzanie ubrań

- Ochrona przed scamem. AI działa lokalnie na telefonie

- Apple też dołączy do nowej ery mobilnej inteligencji

Google Gemini załatwi twoje sprawy w tle na Samsungu

Podczas wczorajszej konferencji Galaxy Unpacked 2026 byliśmy świadkami postępującej integracji sztucznej inteligencji ze smartfonami. Zaprezentowane wczoraj urządzenia - Galaxy S26 i Galaxy Buds4 - są wręcz naszpikowane funkcjami AI. Sporo tych nowości opiera się na technologii dostarczonej przez Google. To m.in. wprowadzenie wczesnej wersji beta funkcji oddelegowania zadań w aplikacji Gemini.

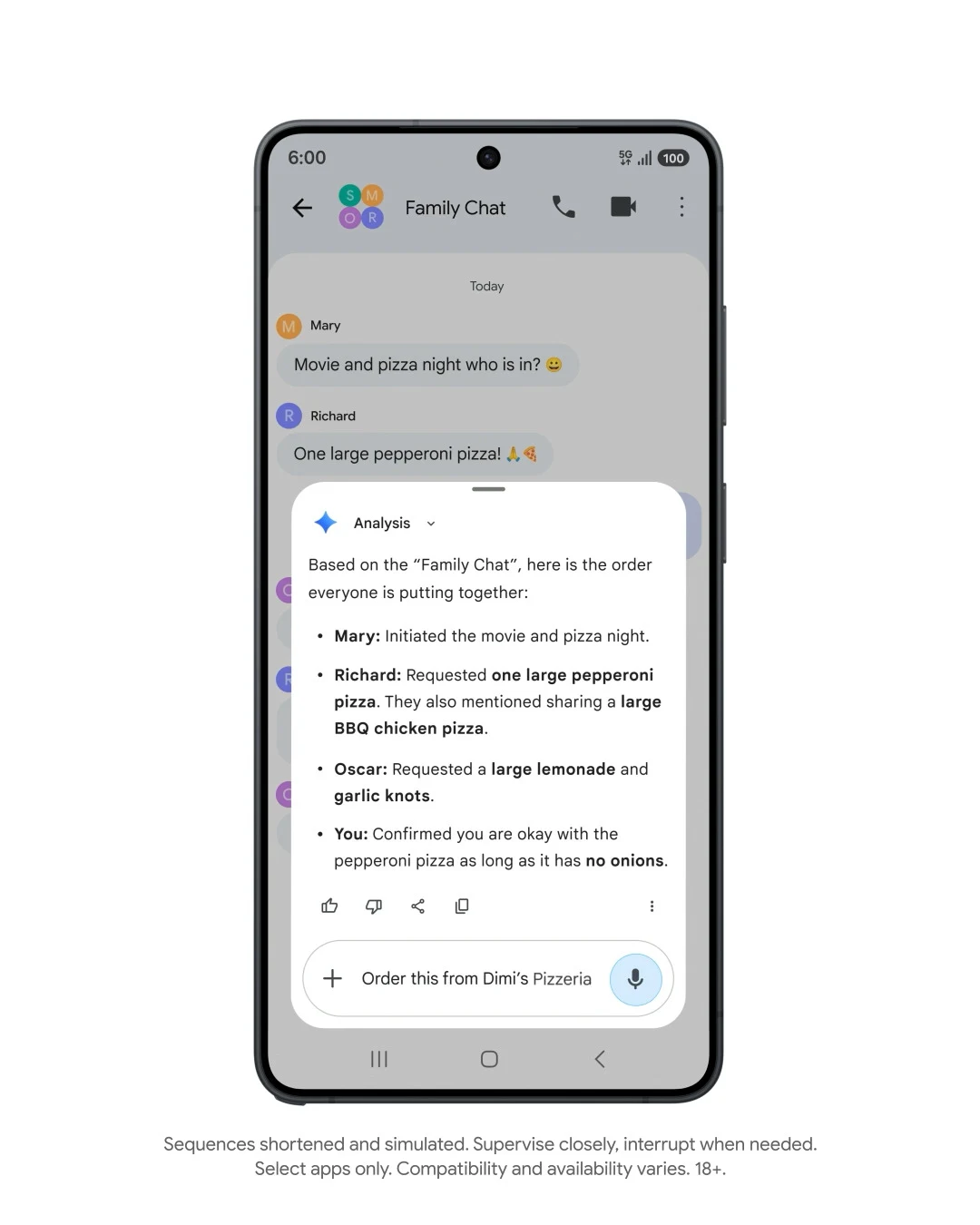

Rozwiązanie to pozwala użytkownikom przekazać sztucznej inteligencji żmudne, wieloetapowe czynności, które dotychczas wymagały ręcznej obsługi. Użytkownicy w USA oraz Korei, korzystający z nowej serii smartfonów, mogą za pomocą długiego naciśnięcia przycisku bocznego zlecić asystentowi m.in. zamówienie przejazdu, zorganizowanie zamówienia obiadu czy skompletowanie koszyka z zakupami spożywczymi.

"Kiedy postanowisz użyć tej funkcji, Gemini działa w tle, a twój telefon nadal jest dla ciebie dostępny do użytku. Skrobnij szybkiego SMS-a albo sprawdź swojego e-maila, gdy on nawiguje poprzez zlecone przez ciebie zadanie. Ty zachowujesz kontrolę, mając opcje podglądu postępów w czasie rzeczywistym bezpośrednio w powiadomieniach, wskoczenia do zadania lub jego zatrzymania" - wyjaśnia Google.

Na starcie funkcja ta będzie wspierać wybrane aplikacje z kategorii dostaw jedzenia, zakupów i przewozów. Zdolność do wykonywania wieloetapowych zadań w imieniu oraz pod kontrolą użytkownika, ale z pewną dozą autonomii, sprawia, że Google Gemini 3 staje się tzw. agentem AI.

Wyszukiwanie obrazem i wirtualne przymierzanie ubrań

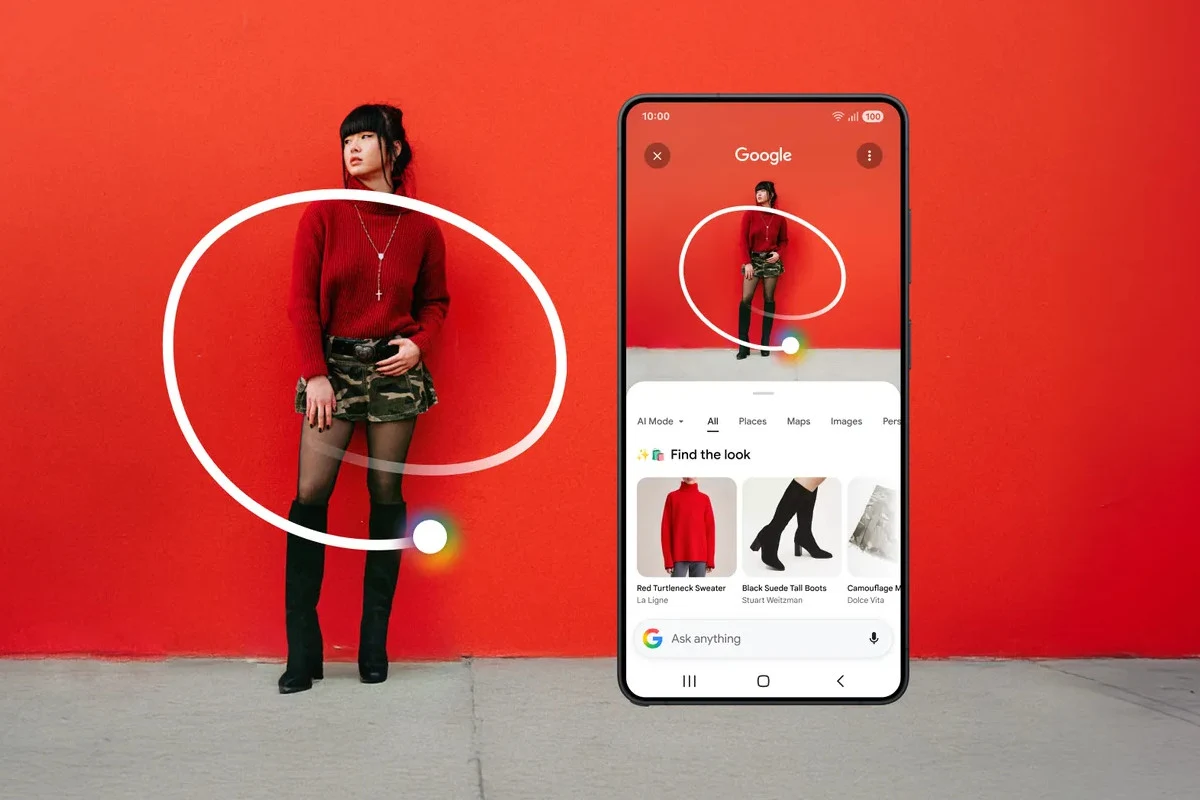

Na lutowej konferencji Samsunga ogłoszono więcej nowości napędzanych przez Google AI. Kolejne dotyczą funkcji wyszukiwania za pomocą zaznaczania na ekranie (Circle to Search), która zyskała możliwość rozpoznawania wielu obiektów jednocześnie. Ulepszenie to skierowane jest do osób szukających inspiracji wizualnych i modowych.

Android na wybranych urządzeniach (w tym na nowej serii Galaxy S26 oraz na Pixel 10 i Pixel 10 Pro) potrafi teraz zidentyfikować wszystkie elementy widoczne na zrzucie ekranu za pomocą jednego gestu. Pozwala to np. na błyskawiczne odnalezienie wszystkich części garderoby na zdjęciu modela czy modelki, bez potrzeby wyszukiwania każdego elementu z osobna.

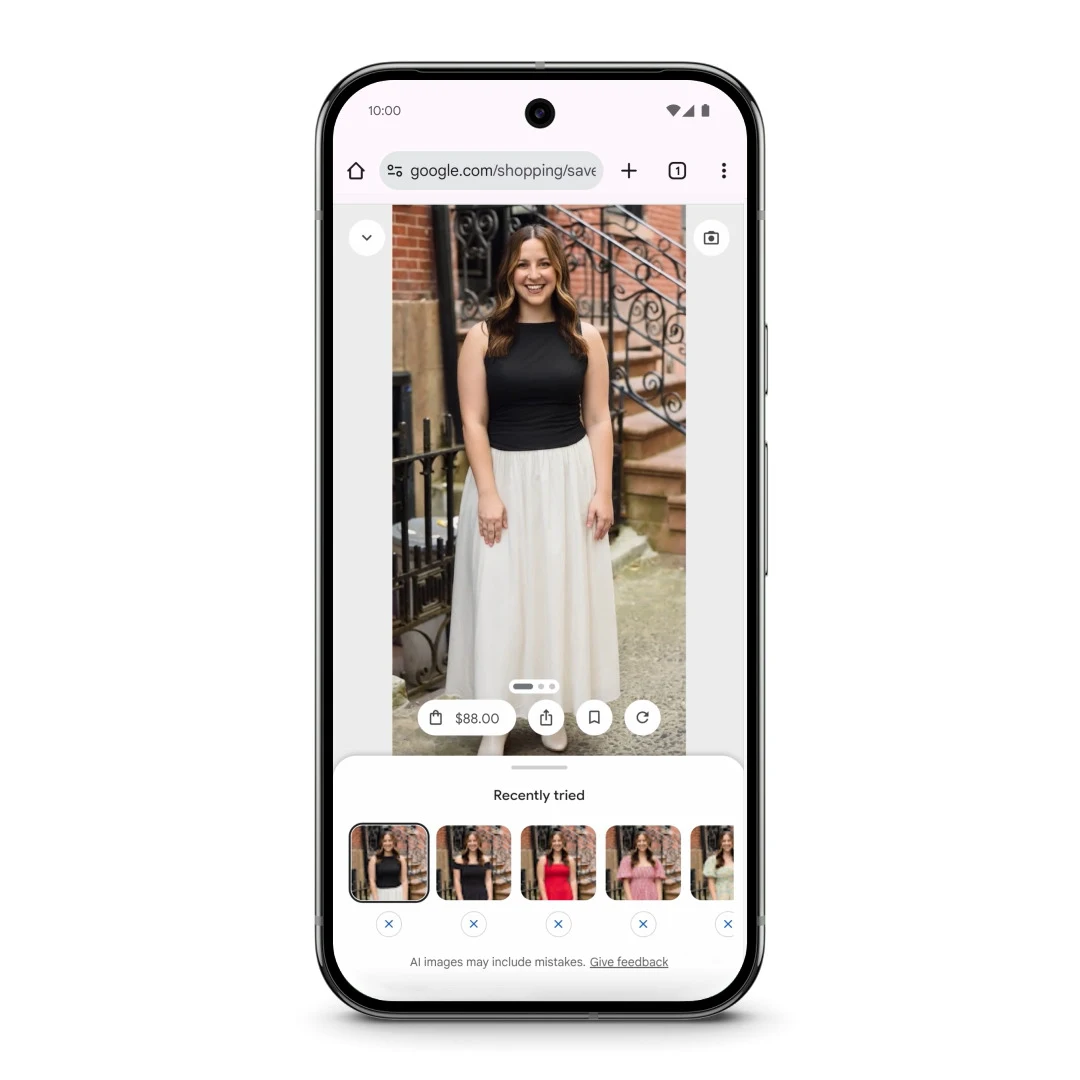

Sztuczna inteligencja Google umożliwia też wirtualne przymierzanie ubrań. Użytkownicy mogą przesłać własne zdjęcie, aby sprawdzić, jak dany element garderoby lub podobne stylizacje z ofert ulubionych marek prezentują się na ich sylwetce. Rozwiązanie to ma ułatwić podejmowanie decyzji zakupowych i lepsze dopasowanie produktów online.

Ochrona przed scamem. AI działa lokalnie na telefonie

Współpraca obu gigantów przełożyła się także na zwiększenie bezpieczeństwa. Dzięki wykorzystaniu wersji modelu Gemini działającego bezpośrednio na urządzeniu telefony z serii Galaxy S26 otrzymały zaawansowany system wykrywania oszustw (Scam Detection) zintegrowany z natywną aplikacją Samsung Phone. Funkcja działa lokalnie, dzięki czemu dane użytkownika nie muszą być przesyłane do chmury w celu analizy.

"Jeśli podczas połączenia zostanie wykryty potencjalny scam, otrzymasz natychmiastowy alert dźwiękowy i haptyczny. By chronić twoją prywatność, Scam Detection analizuje zdarzenia w całości na twoim urządzeniu, a funkcja jest automatycznie wyłączana dla kogokolwiek z twojej listy kontaktów" - wyjaśnia producent.

Apple też dołączy do nowej ery mobilnej inteligencji

Według giganta z Mountain View prezentowane tu nowości stanowią dopiero początek nowej ery mobilnej inteligencji. Modele z serii Gemini 3, które napędzają te rozwiązania, potrafią rozumieć cele użytkownika, zadawać pytania uzupełniające i proaktywnie sugerować kolejne działania, a także w coraz większym stopniu uruchamiać się na urządzeniu, przetwarzając dane lokalnie bez potrzeby ich wysyłania do centrum danych.

Omówione wyżej funkcje będą dostępne na urządzeniach Galaxy S26 już w dniu premiery, a Google zapowiada rozszerzanie ich możliwości w przyszłości.

Wizję podobnie proaktywnej sztucznej inteligencji w ostatnich latach kreślił również Apple. Rozwijana przez niego platforma Apple Intelligence nie była jednak w stanie zintegrować się z asystentką Siri, napisaną jeszcze w czasach asystentów starszej generacji. Wdrożenie tej funkcjonalności było przekładane, a producent iPhone'a wyjaśnił, że napotyka na bariery techniczne. Rozwiązanie ma nadejść z tej samej strony, co w przypadku Samsunga.

Jak pisaliśmy na początku 2026 roku, Apple wybrało Google AI do stworzenia nowej Siri. Można się spodziewać, że funkcje podobne do tych wprowadzanych właśnie na urządzenia Google Pixel i Samsung Galaxy, trafią albo do wiosennej aktualizacji iOS 26.4, albo do dużej aktualizacji iOS 27, która ukaże się jesienią 2026.